/********

Dies ist ein temporär stabiler Explainer über die Politische Ökonomie der Pfadgelegenheiten. Ich editiere hier immer mal wieder rum, nicht wundern.

********/

Dependencies

Einführung

Stellen wir uns die Gesellschaft als multidimensionales Netzwerk von Abhängigkeiten vor, in dem die Akteure wechselseitig abhängig voneinander sind und bei dem die Dimensionen die unterschiedlichen Arten der Abhängigkeit repräsentieren, seien es notwendige materielle Infrastrukturen, Informationen, Arbeit, Produkte, Transaktionen, Aufmerksamkeit oder Care.

.

In dieses Netzwerk kann man dann mit unterschiedlichen Zoomstufen reinschauen.

Auf der Ebene des Haushalts kennen wir uns alle aus. Wir können die Spülmaschine nicht anstellen, weil wir erst noch Essen machen müssen, was aber nicht geht, weil die Teller nicht abgespült sind. Wir stellen fest: Abhängigkeiten sind verknüpft, also vernetzt und vertrackt und einen Haushalt (altgriechisch: „Oikos“) zu führen, bedeutet in erster Linie, materielle Abhängigkeiten zu managen.

Alle Handlungen sind vom Ergebnis anderer Handlungen abhängig, Menschen sind voneinander abhängig, Infrastrukturen, Institutionen, Bräuche und Sprache beschreiben interdependente Abhängigkeiten. Das Netz der Abhängigkeiten ist riesig, kleinteilig und filigran verzweigt und nur mit einem kleinen Teil davon – der, in dem die Abhängigkeiten Preise haben – befasst sich die (neo-)klassische Ökonomie.

Schaut man genauer hin, sieht man viele unterschiedliche Abhängigkeitsformationen als Beziehungsweisen zwischen den Menschen: Care, Lohnarbeit, Konsum, Liebe, Lieferketten, Status-Hierarchien, Gewalt etc. Wir alle sind ständig damit beschäftigt, unterschiedlichste Abhängigkeitsdimensionen zu navigieren und unser Geld hilft bei vielem, aber längst nicht bei allem davon weiter.

Auch wenn wir unsere Sicht auf den Kapitalismus beschränken, können wir die Abhängigkeits-Dimensionen noch differenzierter auflösen. Dann sieht man finanzielle, materielle, personelle und politische Abhängigkeiten und kann beobachten, wie die wiederum auf die internen Strukturen der Firmen zurückwirken.

Schauen wir auf die Wirkung von Unternehmen auf die Gesellschaft, sehen wir wie jede neue Produktkategorie neue, spezifische Abhängigkeiten in das Netzwerk einführt, denn Produkte finden ihren Platz in unseren Lebensritualen und Workflows, die dann ohne sie nicht mehr funktionieren.

Man kann sodann raus-zoomen und stellt fest, dass sowohl Haushalte als auch Unternehmen an allerlei Infrastrukturen gekoppelt sind. Straßen, Schulen, aber eben auch Geschirrspülmittelhersteller und Obstplantagen. Das Netzwerk der Abhängigkeiten wird in kapitalistischen Ökonomien entlang allerlei privater, aber auch einer Menge öffentlicher Infrastrukturen organisiert und diese Infrastrukturen nehmen jeweils relativ netzwerkzentrale Stellungen im Abhängigkeitsnetzwerk ein und sind selbst wieder in ein Netz von Abhängigkeiten verstrickt.

Das Netz der Infrastrukturen ist mit dem Netz der Abhängigkeiten eng verflochten, denn es hat sich in einer Art stetigen Ko-Evolution mit ihm zusammen entwickelt. Abhängigkeiten motivieren die Errichtung von Infrastrukturen und Infrastrukturen kreieren neue Abhängigkeitsbeziehungen.

Zoomen wir noch weiter raus, sehen wir aus dieser Makroperspektive das Netzwerk der Abhängigkeiten am klarsten als Handelsströme zwischen den Staaten und können z. B. an Donald Trumps Zollpolitik, an Russlands geostrategischer Gaspolitik oder Chinas Belt and Road Initiative nachvollziehen, wie Macht unter Staaten entlang von aggregierten Abhängigkeitsrelationen und ihren Infrastrukturen verhandelt wird und sehen, wie sich in diesen Strukturen noch die kolonialistischen Ursprünge des globalen Handelssystems abbilden.

Der Explainer ist in drei Teile geteilt:

- Teil I: Pfadgelegenheit und Hebel:Fulcrum [->]

- Teil II: Der Finanzmarkt [->]

- Teil III: Die „Realwirtschaft“ [->]

Teil I: Pfadgelegenheit und Hebel:Fulcrum

Abhängigkeiten sind eigentlich nur „genommene Pfadgelegenheiten“. Wann immer wir vor der Wahl stehen, Pfad A, B oder C zu nehmen und wir gehen einen Schritt weiter, dann ist es nicht egal, ob wir Pfad A, B oder C genommen haben. Wir sind bei der Pfadentscheidung verschuldet.

Jede Abhängigkeit ist die Abhängigkeit eines Pfades, den man gegangen ist, ob freiwillig oder nicht.

Die Pfadgelegenheit

Für die Pfadgelegenheit selbst existiert ein eigener Expainer, in dem ich sie so definiere.

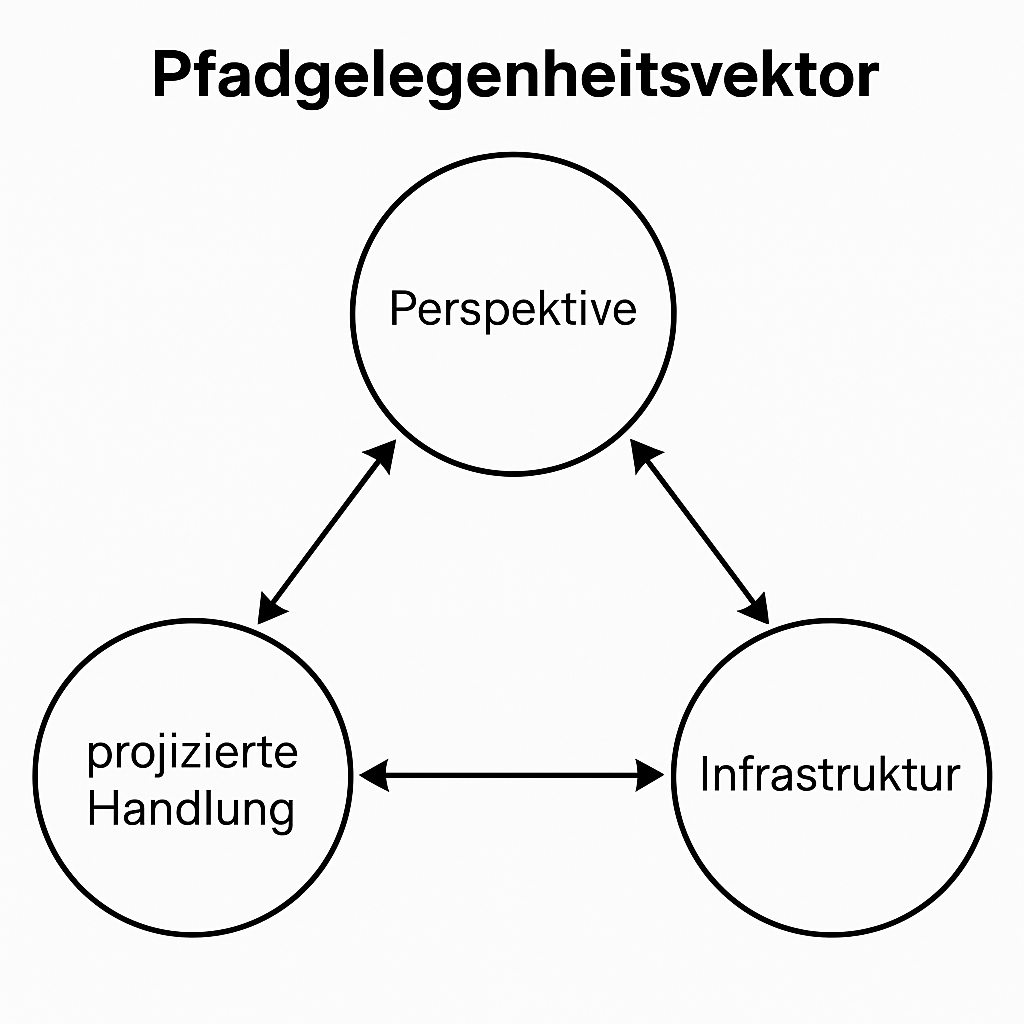

Pfadgelegenheit bezeichnet den interdependenten Vektor aus Perspektive, projizierter Handlung und dafür notwendiger Infrastruktur, durch den sich an einem konkreten Ort zu einer konkreten Zeit unsere „Agency“ entfaltet.

Pfadgelegenheit, Pfadentscheidung, Pfadabhängigkeit sind unterschiedliche Blickwinkel auf dieselbe Sache. Wir sind keine Individuen, die getrennt von ihrer Welt leben und deswegen machen und tun können, was sie wollen, sondern Dividuen, die immer nur auf den Pfaden unterwegs sind, die ihnen zur Verfügung stehen.

Die Hebel:Fulcrum-Mechanik

Die Politische Ökonomie der Pfadgelegenheiten bekommt mit der Hebel:Fulcrums-Beziehung einen mechanischen Vektor, der uns hilft, viele Rätsel aufzulösen. Die Fulcrumsmeachik ist die Aktualisierung einer Pfadgelegenheit: aus einem Potential wird eine ein neuer Ort im Netzwerk.

Aus dem Fulcrum-Explainer.

Pfadgelegenheit und Hebel:Fulcrum sind keine unterschiedlichen Dinge, sondern zwei unterschiedliche analytische „Brillen“, auf dieselbe Sache, zu einer anderen Zeit: Wenn ich die Pfadgelegenheit sehe, eruire ich sie, wenn ich die Pfadgelegenheit nehme, wird sie zum Hebel, der ein Fulcrum bedient. Oder anderum: Die Pfadgelegenheit ist der Blick des Dividuums auf ein Hebelpotential.

Im Bedienen des Hebels aktualisert sich die Pfadgelegenheit, die „projizierte Handlung“ wird zur „Handlung“, der Hebel ist umgelegt und das Fulcrum wurde belastet.

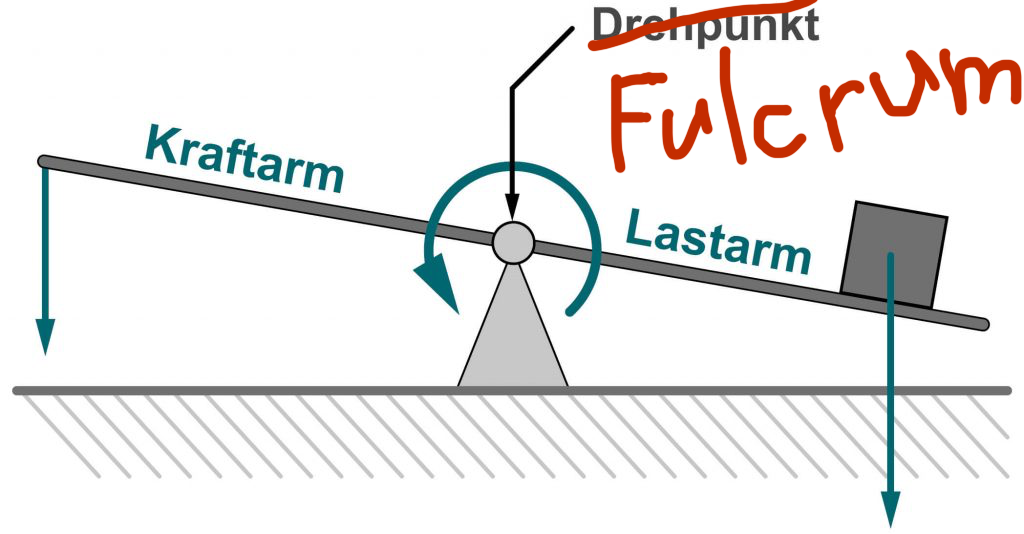

Um diesen Explainer zu verstehen, lohnt es sich den Fulcrums-Eplainer ganz zu lesen, aber grob zusammengefasst kann man sagen (KL76):

Der Hebel ist das, worauf du direkt Kraft (Arbeit, Input, Query, Prompt, Eigenkapital) ausübst und das Fulcrum ist das, was die Kraft überträgt und durch Stabilität und Steifheit verstärkt. Gleichzeitig ist das Fulcrum aber auch, das was „halten“ muss, damit die Hebelaktion „gelingt“ und weil man das aber ja nie vorher wirklich wissen kann, ist das nichts weiter als eine formulierte „Erwartung“, was jede Hebelaktion gleichzeitig zur „Wette auf das Fulcrum“ macht und dazu führt, dass wir alle bis über beide Ohren bei unserer Infrastruktur „verschuldet“ sind.

Denkt man das Fulcurm in seiner Komplexität, vereinfacht sich aber etwas anderes, denn dann wird die Hebel:Fulcrums-Beziehung mehr als metaphorisch, sondern analytisch anwendbar auf praktisch alle Weltnutzungsbeziehungen, also eigentlich alles, was wir hier „Pfadgelegenheit“ nennen.

Wie gesagt, es lohnt sich den vollen Explainer zu lesen. Aber um die Hebel:Fulcrums-Beziehung analytisch anwenden zu können, lohnt es sich, die unterschiedlichen Arten auf das Fulcrum zu schauen, noch einmal zusammenzufassen:

- inszeniertes Fulcrum[F0] = viabel / Die Pfadgelegenheit

- zugriffliches Fulcrum[F1] = Ansatzort / Zugriffs-Topologie /

- hegemoniales Fulcrum[F2] = die Verbreitung der Zugriffs-Topologie

- beliehenes Fulcrum[F3] = Wette auf die Gesamtinfrastruktur

- Kontaktzonenfulcrum[F4] = Kontaktzone / Steifheit / Robustheit / Verschleiß

- stabilisierendes Fulcrum[F5] = Stabilitätskern / Die Fulcren, die dem Kontaktzonenfulcrum Stabilitität verleihen

- verdrängtes Fulcrum[F6] = externalisiert / verdrängt

- verbuchtes Fulcrum[F7] = habituelles Pfadgelegenheit-Portfolio

- Fulcrums-Crash[F8] = Der Riss im Fulcrum und seine Geschichte.

- abgeschriebenes Fulcrum[F9] = Ruine

Kapitalismus aus Userperspektive

Die politische Ökonomie der Pfadgelegenheiten versucht, eine bessere Beschreibung des Kapiltalismus und seinen Strukturen zu erreichen, indem sie die Userperspektive auf seine Mechanismen und Strukturen beleiht.

Auf diese Weise verbindet sich das Dividuum über seine Pfadgelgenheiten mit den Strukturen und der Kapitalismus wird als begehbare Architektur von Hebel:Fulcrums-Beziehungen beschreibbar.

Als pfadabhängiger Teil des relationalen Materialismus basiert auch die politische Ökonomie der Pfadgelegenheit auf einem drei Schichtenmodell der Gesellschaft und des Dividuums. Aus dem den relationalen Materialsmus-Explainer.

Ich schlage ein drei Ebenen-Modell der Gesellschaftsbeschreibung vor:

- Das Netz der materiellen Infrastrukturen, d.h. der materiellen Hebel und ihrer materiellen Fulcren.

- Daraus hervorgehend, darauf aufbauend und eng verkoppelt: Das Netz der Erwartungen, d.h. die Erwartungs-Portfolios der materiellen Infrastrukturen der Dividuen.

- Daraus hervorgehend, darauf aufbauend und eng verkoppelt: Das Netz der Erwartungserwartungen, d.h. die Erwartungs-Portfolios an die Erwartungen anderer – semantische Infrastrukturen.

Alle Akteure in diesem Netzwerk sind „Materiell-Semantische Komplexe“ (menschliche Dividuen, Unternehmen, Staaten, Redaktionen, Vereine, Organisationen, auf eine Art auch Tiere) und das heißt sie haben sowohl einen materiellen Körper (Menschliche Körper und materielle Infrastrukturen inklusive deren Fulcren) und einen semantischen Körper (Gewohnheiten, Sprache, Kultur, Wissen, eine Geschichte über sich selbst und die Welt), bewohnen also als „Full Stack“-Implementation alle Layer des Netzwerks. Sie alle sind Fulcren (für jemanden), sie alle nutzen Hebel (an jemanden), nur sind Hebellänge und Fulcrumslast ungleich verteilt.

In diesem Geflecht aus Materialität und Semantik lassen sich plausible Userperspektiven auf Funktionsweisen und Mechanismen ableiten, die uns die Welt entlang aggregierter Dividuums-Perspektiven erklärt.

Was sind also Abhängigkeiten?

Der relational Materialismus erlaubt uns mehrere Arten, Abhängigkeiten zu definieren, die jeweils richtig sind und und auf jeder ihrer Ebenen eine Gültige Perpektive auf Abhängigkeiten formulieren.

Materielle Ebene: Abhängigkeiten sind die Fulcren unserer Hebel.

Erwartungs-Ebene: Abhängigkeiten sind Pfadabhängigkeiten, von denen unsere Pfadgelegenheiten abhängen.

Erwartungserwartungs-Ebene: Abhängigkeiten sind die gemeinsam beliehenen Erwartungs-Portfolios unserer Infrastrukturen.

Im Text wechsele ich die Ebenen fluide, denn so ist die Welt, wie wir sie wahrnehmen. Du nimmst diese Unterscheidungen nicht immer wahr, weil du immer nur in der Erwartungs-Ebene operierst, die die Eindrücke der materiellen Realität und deiner Erwartungserwartungen mit deinen Erwartungen zu „deiner Wirklichkeit“ verschmilzt.

Teil II: Der Finanzmarkt

Archimedes konnte nicht ahnen, dass seine Praxis des „Leveragen“ in der Finanzsprache beliehen werden würde, aber uns ist jetzt auch klar warum? Auch dort ist jeder Hebel eine Wette auf ein Fulcrum.

Leverage in der Finanzwelt

Für gewöhnlich bezieht sich das Wort „leverage“ am Finanzmarkt auf geliehenes Geld, das man seiner „Order“ beifügt. Sagen wir, ich habe 10.000 Euro Eigenkapital und leihe mir für eine „Order“ weitere 100.000 Euro, dann verstärkt das meinen Hebel 10x. Wenn also der Preis 1 % steigt, habe 10 % gewinn gemacht, wenn er um 1 % fällt, habe ich 10 % Verlust gemacht.

Wäre das Fulcrum fix und ein Punkt, dann könnte der Hebel unendlich groß sein, was wir als Hinweis darauf lesen können, dass wir es auch hier mit einem „komplexen Fulcrum“ zu tun haben.

Das erste, was ein Anleger macht, ist zu fragen: Ist ein Anlegepfad „viabel“?, Dafür inszeniert man eine Zukunft entlang einer bestimmten Erwartung: Wird der Preis für das Asset weiter steige? Kann ich mir das leisten? Wie sicher ist das? Das „Inszenierte Fulcrum“ [F0] ist die Eruierung der Anlegepfadgelegenheit.

Das nächste, was der Anleger tun muss, ist das „zugriffliche Fulcrum“ [F1] zu wählen, den technischen „Ort“ der Wette (welche Infrastruktur setzt den Trade um) und aber auch den Zeitpunkt/Kurs, an dem er sich entschließt zu kaufen/den Hebel anzusetzen. Manchmal ist das einfach so schnell wie möglich, aber viele haben ganz bestimmte Wertentwicklungszeitpunkte im Visier.

Die Hürden, die man an zugrifflichen Fulcren überwinden muss, um am Finanzmarkt mitzuspielen sind auf eine Art hoch (denn als erstes braucht es „überflüssiges“ Geld und Kreditwürdigkeit), aber mit Apps wie Robin Hood und Trade Republic sind dafür andere Hürden gesunken. Diese Apps versuchen ihr ugriffliches Fulcrum auf die Trade-Pfadgelegenheit hegemonial zu machen [F2], aber geleveragte Bets machen sie noch nicht in der Höhe, also geht der Anleger klassisch über einen „Broker“.

Als nächstes nimmt der Anleger Kredit auf und plaziert seine Wette. Um die 100.000 zu bekommen, beleiht der Anleger nicht nur das gekaufte Asset, sondern auch die „Sicherheiten“, die er für den Kredit hinterlegt. Das „beliehene Fulcrum“ [F3] umfasst also nicht die Werterwartung des gekauften Assets, sondern auch die Werterwartung der beliehenen Vermögenswerte für den Kredit. Das alles steht jetzt zusammen auf dem Spiel.

Während der Hebelaktion verschiebt sich erstmal der Fokus auf das „Kontaktzonenfulcrum“ [F4]. Denn jetzt ist es nicht nur so, dass der Wert des investierten Assets eine Rolle spielt, sondern auch der Wert der anderen beliehenen Assets aus [F3]. Das Kontaktzonenfulcrum kommt in die Existenz, sobald es „belastet“ wird, also die Hebelaktion beginnt und seine tatsächliche Stabilität, besorgt das, womit die Wette [F3] beliehen wurde. Zum Kontaktzonenfulcrum gehört aber auch die erwartete Wertentwicklung des gekauften Assets, sowie die Wertentwicklungserwartung anderer, was die ganze Konstruktion fragil und teils volatil macht.

Deswegen dienen die für den Kredit beliehenen Assets als stabiliserendes Fulcrum [F5]. Ihre erwartbarkeit erlaubt höhere Volatilität und damit längere Hebel. Je stabiler das beliehene Asset ist, desto weniger macht sich eine Bank Gedanken, wie sehr die Gefährlichkeit des Hebels die Rückzahlungsfähigkeit gefährdet. Und umso größere Hebel kann man sich leihen. Aber das ist gleichzeitig die Vulnerabilität. Wird die Stabilität des stabilisierenden Fulcrums [F5] nicht eingelöst, droht das Konstrukt zu zerfallen. Wenn ich zum Beispiel Aktien als Sicherheit hinterlegt habe und die Aktien sinken im Wert, dann kann mich ein sogenannter „Margin Call“ erreichen. Die Bank fordert entweder mehr Assets ein, oder löst den Vertrag auf [F8] und verkauft meine hinterlegten Sicherheiten [F9]. D.h. die Stabilität meines Fulcrums basiert zu einem Gutteil auf der Stabilität der beliehenen Assets. Wie wir später herausarbeiten werden, fungieren Sicherheiten, deswegen als stablisierendes Fulcrum, weil es der Bank einen „Exit“ aus der Wette ermöglicht.

Das „verdrängte Fulcrum“ [F6] ist immer mit dabei und es ist vielfältig, auch dann, wenn die Hebelaktion gut geht. Ein besonders gern verdrängter Teil des Fulcrums bei Finanzgeschäften ist die Tatsache, dass man es sich leisten können muss, das Risiko einer gehebelten Wette überhaupt einzugehen. Auch die eigene sozioökonomische Situation wird bei jedem Kredit mitgeleveraged.

Das „verbuchte Fulcrum“ [F7] wird das ganze, wenn die Hebelaktion gelingt und das gehebelte Asset in gewünschter Höhe im Portfolio liegt, oder die Option aufgeht. Aber ebenfalls verbucht ist der Hebelpfad selbst. Ein geglückter Hebeleinsatz verleitet dazu, die Geste zu wiederholen. Die allgemeine Pfadgelegenheit „Hebeln“ wurde Nutzenaktualisiert gewinnt als „viabler Pfad“ an Wert im persönlichen Erwartungs-Portfolio.

Es sei denn, die Hebelaktion mißlingt. Sei es, weil die Wertentwicklung vom erwarteten Pfad abwich, sei es, dass das stabilisierende Fulcrum [F5] brach (Margin Call). Die Erwartungen an die Infrastruktur waren nicht durch die Realität „gebackt“. Was im Fuclrums-Crash [F8] zu Tage tritt sind die eigenen verdrängten Erwartungen und Erwartungserwartungen.

Der Margincall ertönt, ich habe keine Assets mehr zusätzlich zu hinterlegen, dann verkauft die Bank die hinterlegten Assets. Die Verluste werden zum „abgeschriebenen Fulcrum“ [F9]. Das „abgeschriebenen Fulcrum“ hat immer ein Nachleben, denn jede ehemalige Infrastruktur, die gebaut, steht in der Welt und hat Wege und so sucht man Anschlussverwendungen für abgeschriebene Fulcrumsruinen. Das heißt, es wird versucht, sie in neue Nutzenpfade zu integrieren und das gelingt mal schlecht, mal besser.

Finanzassets

Doch man kann den Hebel auch in allen „ungeleveragten“ Finanzgeschäften finden (1x Hebel sind auch Hebel) und das erlaubt uns, mit der Analyse noch tiefer gehen.

Ökonom*innen haben sich immer gefragt, worauf genau Investor*innen wetten und haben so Antworten wie „Fundamentuals“, „aktuelle und zukünftige Cashflows“ gegeben und es wurden Formeln aufgestellt wie Discounted Cash Flow, oder einfach P/E-Ratios (Preis/Gewinn) oder ähnliches.

Klammern wir für einen Moment die Tatsache aus, dass wir mit unseren Erwartungen und Preisen immer schon im Raum der Erwartungserwartungen operieren (Wie „Memestocks“ und Techwerte regelmäßig belegen, indem sie auf Fundamentuals scheißen).

Nehmen wir klassischer Weise an, dass es um „Fundamentials“ geht, wir also einen möglichst „rationalen Blick“ auf den Pfadwert eines Unternehmens werfen wollen, dann fällt als erstes auf, dass die Investition eben nicht nur eine Wette [F3] auf das Asset selbst, sondern auch auf den seines Kontextes ist.

Das stabilisierende Fulcrum [F5] und damit der Werterwartung von Asset X basiert auf der Stabilität der Erwartungen, von denen die Werterwartung abhängig ist und das umfasst alle notwendigen Infrastrukturen des Unternehmens X. Wie funktionsfähig und robust ist das Geschäftsmodell, wie entwickelt sich die „Stimmung am Markt“, wie verändert sich die Konkurrenzsituation, wie gut liefert das Management, wie verändern sich die politischen Rahmenbedingungen – all den Kram, den Analysten für eine detaillierte Pfadbewertung so zusammentragen.

Doch da ist mehr: Die betreffende Firma ist selbst wiederum abhängig von der wirtschaftlichen Gesamtlage, davon, dass seine Zulieferer verlässlich liefern, die Banken verlässlich Liquidität bereitstellen, die Mitarbeiter*innen (größtenteils) gesund sind, nicht streiken und verlässlich zur Arbeit kommen, dass die Straßen und Schienen für die Logistik nutzbar sind und dass die Sicherheit der Projekte gewährleistet ist. Außerdem, dass das politische System, in dem die Firma operiert, stabil bleibt, ihr Geschäftsmodell auch morgen noch legal ist und die Gesetze morgen noch gelten. Auch ein halbwegs stabiles Klima gehört für Firmen oft zum verdrängten Fulcrum.

All das wird durch eine einfache „Order“ „geleveraged“.

Wenn ein Kurs fällt, dann oft, weil sich bestimmte Kontextbedingungen änderten, die man gar nicht so sehr auf den Schirm hatte. Die Pfadbewertung ist immer implizite Fulcrumsbewertung.

Finanzmarkt

Der Finanzmarkt ist überall wo er auftritt eine künstliche geschaffene Infrastruktur, die bereits seit den 1970ern größtenteils in Software umgesetzt ist und eine für jeden anderen „Markt“ unübliche Übersicht über die Marktteilnehmer*innen erlaubt und momentane, in Echtzeit erfasste Preisbewegungen abbildet.

Auf dem Finanzmarkt kann man auf Pfade wetten, indem man in Unternehmen investiert, die den Assets unterlegt sind. Was man dabei konkret beleiht, hängt von einem selbst ab: Ist es eine Analyse der „Fundamentials“, ist es die Geschichte, die der CEO erzählt (zum Beispiel Musks Stories), oder es ist einfach das, worauf „alle vertrauen“ (ETFs), oder es beleiht gar eine Identität (Bitcoin, Crypto, Memestocks), andere wollen einfach generell in „KI“ investieren, weil sie an die AGI story glauben. Am Ende wetten alle auf Geschichten.

Und der Finanzmarkt funktioniert dann so, dass eine Investition nicht nur eine persönliche und private Einlage deines Gelds (und deiner Erwartungen) ist, sondern diese Investition verändert den Preis (wenn bei uns Normalos auch nur minimal) und damit auch die Werterwartungen aller anderen.

Praktisch funktioniert das dann wie die Öffentlichkeit (siehe oben), als Trommelkonzert. Krasse Links No 23:

Der „Wert“ von gehandelten „Assets“ wird durch Öffentlichkeitsmechanismen bestimmt.

Zentrale Handelsmärkte für Anlagegüter sind in Infrastruktur gegossene Ideologie. Anders als der Markt für bsw. Waschmaschinen sind Handelsplätze keine gewachsenen infrastrukturellen Gegebenheiten, sondern dem künstlich dem Idealbild des neoklassischen Marktes nachempfunden, alle Anbieter und alle Nachfrager kommen zusammen finden einen Preis. In der Theorie werden „Signale“ dadurch „verarbeitet“, dass sich alle Akteure gegenseitig versuchen „outzusmarten“, doch in der Praxis geht es meist darum, wer die größere Trommel hat.

Hier, wie ich glaube, dass der Aktienmarkt wirklich funktioniert: Unternehmen präsentieren sich der Öffentlichkeit als Projekte, die davon erzählen, wie sie ihre bereits vorweisbaren Infrastrukturen dazu leveragen werden, um noch mehr Abhängigkeiten zu schaffen oder zu konzentrieren. Mit anderen Worten: Am Aktienmarkt werden Geschichten gehandelt, also getrommelt.

Und natürlich gibt auch es hier die übermäßig großen Pauken, die den Beat vorgeben und eine wilde Schaar von kleinen bis mittelkleinen dazu improvisierenden Percussions. Wenn Goldman Sachs mit einem von den Erwartungen abweichenden Preis in ein Projekt reingeht, sortiert das die Karten neu und die Percussions passen ihren Beat an. Die Finanz-Oligarchie gibt mehr oder weniger die Shots vor, und alle anderen Wetten nur darauf, welche Geschichten sich ein paar ultrareiche Männer auf dem Golfplatz erzählen.

Egal, ob ich Aktien, Bitcoin, NFTs, ETFs, oder Optionen kaufe, ich investiere in ein Narrativ (einen imaginären Pfad) und meine Kaufentscheidung ist zugleich ein Signal an andere, dass ich einen Pfad für Wertvoll erachte. Bei jeder Finanztransaktion beleiht man also immer auch die Erwartungen der anderen, ihren Glauben an die gemeinsam finanzierten Geschichten.

Insofern kann man das ganze Memestock-Gerede getrost beiseite legen, denn, turns out: Jede „Stock“ ist ein Memestock. It’s storys all the way down. Insofern ist an der Robinhood/Memestock-Selbsterzählung etwas dran: Die organisierten Kleinanleger-Trommler, die sich auf Reddit zusammengetan haben, mischten die Rich Mens Memes auf und schafften es, zumindest temporär, einen eigenen Beat zu setzen und durchzuhalten.

Doch im Gegensatz zu ihrer Selbsterzählung bilden sie damit keinen echten Wert ab, sondern legen offen, wie das System wirklich funktioniert.

Man muss nur immer weiter trommeln: Hodl, Hodl, Hodl, buy the dip! Und achtet auf den Beat, den Beat! Diamond Hands! FOMO! Und der Beat, der Beat, der Beat! Do your Own research! Einfach immer weiter trommeln, FUD! FUD! FUD! Don’t trust, verify! Im Trommeln liegt die Wahrheit, we all gonna make it!, etc.

Der Finanzmarkt ist ein Kommunikationssystem das aus einer dynamischen Transitionsmatrix besteht, in der sich die verteilten Erwartungen der Anleger*innen über bestimmte kapitalistische Erzählungen durch Geld oder Securities „gebackte“ Sprachakte (Orders/Trades) zu Erwartungserwartungen (Keynes’ Beauty Contest) synchronisieren.

Das Ergebnis dieser Synchronisation (Preise, Spreads, Volas, Kurven) sind nicht „die Wahrheit“, sondern oftmals die Fieberkurven der allgemeinen Trommel-Trance, wenn die Oligarchen mit ihren Riesen-Pauken mal wieder bestimmte Narrative (E-Commerce, Crypto, AGI, „Wachstum“ als „Wohlstandsgarant“) als handlungsleitende Attraktoren aufgegleist haben.

Blase

Wie jede Pfadgelegenheit ist auch das Asset eine Wette auf die Zukunft, doch sie ist vergleichsweise riskant. Pfade haben es so an sich, dass sie von Erwartungen abweichen und das kann offensichtlich passieren: der Wert meine Aktie sinkt – oder erstmal weniger offensichtlich: das, was meine Aktie wertvoll macht, sinkt. Dabei kann sich ein „Spread“ entwickeln zwischen der allgemeinen Erwartungen an ein Fulcrum und seiner tatsächlichen Stabilität.

Das nennen wir „Blase“.

Der Ökonom Hyman P. Minsky argumentiert, dass es die alltäglich erfahrene Kontaktfulcrums-Stabilität [F4] ist, die die Leute dazu verleitet, immer mehr und immer größere Hebel daran anzusetzen: „Stability is destabilizing“ sagt er in „Stabilizing an Unstable Economy“ von 1986.

Die Finanzkrise von 2008 fing nicht mit „Lehman Brothers“ an, auch nicht mit Fannie Mae and Freddie Mac, sondern mit dem Bruch [F8] eines verdrängten [F6] aber tiefersitzenden stabilisierenden [F5] Fulcrums: dem Spread zwischen der realen Rückzahlungsfähigkeit der Haushalte, die eine Hypothek aufgenommen hatten und der Rückszahlungserwartung ihrer Gläubiger. Deren nun wertlosgewordene Kredite wurden oft als „Subprime Mortages“ mit allerlei anderen Krediten vermischt und verpackt verkauft. Aber als diese Kredite durch erhöhte Ausfallraten „faul“ wurden und man nachschaute, was da los ist, crashte auch das Vertrauen in die Rating-Agenturen, die, wie sich herausstellte, gar nicht hingeguckt haben. Die Kontrollverlustschulden durch ineffektive Korrekturhebel wurden plötzlich offenbar. Auf einmal war nicht mehr klar, welcher Kredit betroffen ist – also waren alle Kredite betroffen.

Die Stabilität aber, die diese Instabilität hergestellt hat, war die vermeintliche Verlässlichkeit des Immobilienmarktes bezüglich seines Return of Investment. Der Markt hatte einige Jahrzehnte einen stetiges Wertwachstum erfahren und Kredite in Immobilienfinanzierung galten als „safe Bet“ – als Stabilitätsanker einer sonst volatilen Finanzwelt.

Das heißt, sie wurden zum stablisierenden Fulcrum anderer finanzieller Infrastruktur, also weiteren, darauf aufbauenden Wetten. Konkret: Finanz-Derivate (MBS, CDO, Repo-Collateral, CDS-Versicherungen) die diese Schulden als Stabilitätsanker ihrer ansonsten riskanteren Hebel nutzen. Diese Hebel waren besonders bei Banken beliebt, wo die toxischen Assets überall in den Büchern standen (verbuchtes Fulcrum [F6]), um andere Investitionen rechtfertigten.

Minsky bedeutet: Die erfahrene Kontaktfulcrum-Stablität erzeugt Erwartungs-Stablität und Erwartungserwartungs-Stabilitität, die die Akteure dazu verleitet, sich zu erlauben, immer größere und riskantere Hebel an das Fulcrum anzusetzen, ohne dabei die sie stabilisierenden Fulcren im Blick zu behalten.

Minsky identifiziert den Moment wo die Finanzierung in die Blase kippt an dem Punkt, an dem die Gewinne aus der Preissteigerung der Assets größer werden, als die aus Nutzung des Assets. Dann kommt es zu einem Kreislauf: Geld erzeugt Erwartung und Erwartung erzeugt Geld.

Minsky führt drei Phasen ein:

- Hedge Finance = stabile Pfadgelegenheit, die Schuld kann aus laufendem Cashflow bedient werden.

- Speculative Finance = instabile Fulcrum-Balance, der Cashflow reicht nur für die Zinsen.

- Ponzi Finance = Erwartungs-Fulcrum, Schulden können nur durch steigende Schulden bedient werden, also durch die Aquirierung neuer Gläubiger.

Aber da ist noch etwas anderes: Wenn Pfade als „sicher“ gelten, dann gewinnen immer die, die die größten Hebel organisieren können. Sei es, weil sie einfach mehr Kapital, eine bessere Kostenstruktur, ein größeres Marketing-Budget, oder tatsächlich den besten materiellen Hebel haben.

Das Wachstum skaliert also nicht gleichmäßig, sondern konzentriert sich bei wenigen großen Hebeln. Das heißt: bereits populäre Fulcren gewinnen überproportional an Macht (Netzwerkzentralität) und die Topologie entwickelt sich immer weiter in Richtung skalenfreiem Netzwerk mit Paretoverteilung (20 % der Knoten haben 80% der Verbindungen, 80% der Knoten teilen sich 20 % der Verbindungen) der Fulcrums-Zentralitäten mit den entsprechenden Engstellen und Kritikalitäten (aus denen entsprechend hohe Marge abgeschöpft wird). Damit einhergehend geben Wettbewerber auf, lokalere Strukturen veröden, Pfadalternativen schwinden, das Netzwerk dünnt aus und verengt sich auf wenige große Infrastrukturpfade.

Nach dem Kollaps der erwarteten Hauskreditrückzahlungs-Erwartungen stellte sich heraus, dass ein kleiner, aber im Beleihungs-Netzwerk netzwerkzentraler Knoten wie „Lehmann Brothers“ teil des stabilisierenden Fulcrums [F5] des ganzen Bankensektors war, der durch den eigenen Kollaps das ganze Bankensystem zum Einsturz bringen konnte. Das war der Punkt, an dem man eilig begann, Netzwerkzentralitäten gezielt zu „retten“ („Too Big To Fail“).

Der „Kipppunkt“ ist also kein Punkt, sondern ein Pfad. Ein Crack, der irgendwo in den Tiefen des verdrägten Fulcrums anfängt – dort wo Realität auf Erwartung trifft (häufig Cashflows, aber es kann auch etwas anderes sein: eine Erzählung, die nicht mehr stimmig ist, auf der viele andere Erzählungen basieren (New Economy, AI, Bitcoin) – der sich auf andere Fulcren ausbreitet, die dieses Fulcrum beliehen haben. Der Crack breitet sich entlang der Beleihungsstrukturen aus und wird in einem skalenfreien Netzwerk früher oder später auf Bücher einer Netzwerkzentralität treffen und wenn die ebenfalls instabil werden, sind etliche Banken betroffen, die Lehman Brothers auf die eine oder anderen Art beliehen haben, was eine Bankenkrise auslöst, die alle Portfolios rundherum kollabieren lässt. Ein „Kippunkt“ funktioniert wie ein Virus, der sich über einen Infektionspfad und beschleunigt durch „Superspreader“ in den Beleihungsstrukturen ausbreitet.

Auf das Trommelbeispiel bezogen fangen dann Trader im größeren Maßstab an, Assets zu liquidieren, entweder, um toxische Assets loszuwerden, oder um andere Wetten am Laufen zu halten, deren beliehenes Fulcrum [F3] im Wert abgesackt ist und der Margin Call droht. Das heißt da verändert jemand seinen Beat und umliegende Trader werden aufmerksam, einzelne checken das Problem und stellen fest, dass sie selbst betroffen sind und beginnen ebenfalls mit dem Verkauf. In Windeseile verbreitet sich der neue Beat: Wessen Wert ist nicht mehr zu trauen, welche Erzählung sind wie zusammengebrochen und welche pfadabhängigen Erzählungen davon sind betroffen und nun checken alle ihre „Exposure“ und handeln danach.

Und so grandios man sich gegenseitig nach oben getrommelt hat, umso schneller trommelt man sich runter. Bis das ganze Vertrauen niedergetrommelt wurde und niemand mehr jemand anderem Vertraut. Nach der Finanzkrise die Bankenkrise. Banken gaben sich keinen Kredit mehr (sahen sich nicht mehr als viable Pfadgelegenheit: Bruch des viablitäts-Fulcrums [F0]), weswegen der Staat eingreifen musste, als „Lender of Last Ressort“, letztes vertrauensvolles Asset, aber auch letzter viabler Pfad zu Liquidität. Und weil all das die Staatsfinanzen leveragte hatten wir danach eine „Staatshaushaltskrise“ und dann „EU-Stabilitätskrise“. Es waren die Wellen des Crashs, die sich in konzentrischen Kreisen durch die infrastrukturellen Fulcren ausbreiteten.

Und durch die skalenfreie Struktur des Finanzmarktes bekamen wir einen kaskadieren Kollaps, den Seneca Effekt, basierend auf Scenecas Beobachtung:

Whatever structure has been reared by a long sequence of years, at the cost of great toil and through the great kindness of the gods, is scattered and dispersed by a single day. Nay, he who has said „a day“ has granted too long a postponement to swift-coming misfortune; an hour, an instant of time, suffices for the overthrow of empires! It would be some consolation for the feebleness of our selves and our works, if all things should perish as slowly as they come into being; but as it is, increases are of sluggish growth, but the way to ruin is rapid.

Meine Theorie ist also die von Minsky, nur mit Verdrängung und Netzwerkeffekten.

Eine Blase entsteht, wenn stabile Kontaktzonen-Fulcren Erwartungsstabilität erzeugen, Hebel sich stetig vergrößern und durch Preferential Attachment auf wenige Netzwerk-Hubs konzentrieren und dann verdrängte, aber stabilisierende Fulcren brechen, weil sie nicht mitskalieren, worauf das skalenfreie Netzwerk kollapsartig reagieren kann.

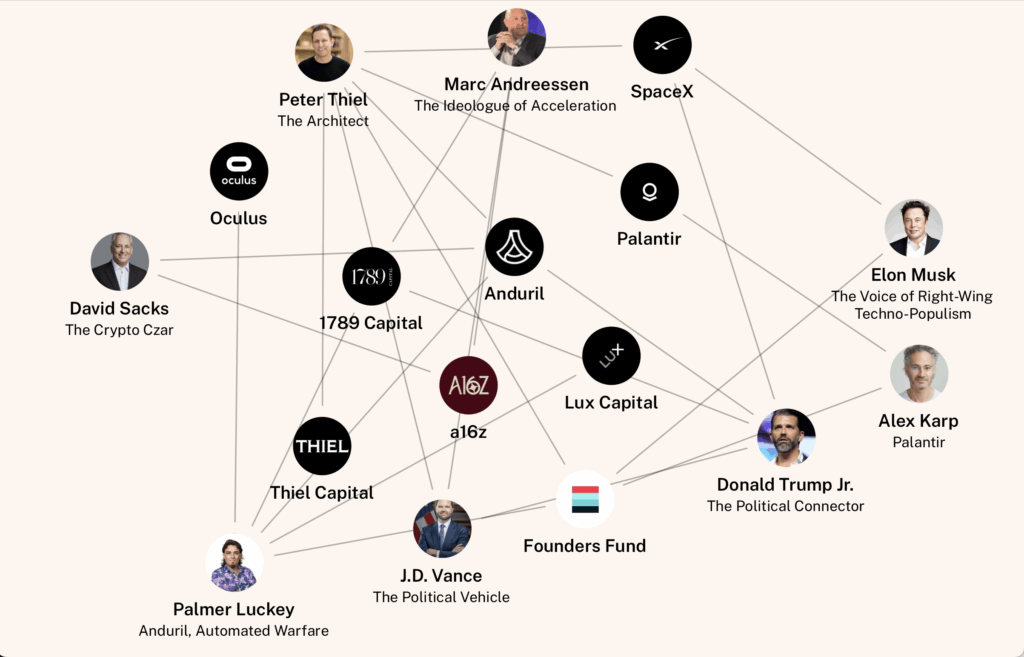

Auch heute laufen wir längst im Ponzi Finance Modus. Das Kontaktfulcrum des Kapitalismus scheint noch intakt, aber unten, bei den stablisierenden Fulcren rumort es gewaltig. Und während die KI-Hebel immer größer werden und mit immer größeren Kredithebeln finanziert werden, ist die skalenfreie Struktur heute bereits in allen Wirtschaftsbereichen ausgeprägt und in der Vermögensverteilung ablesbar. Seit sich sehr populäre Stablitätserwartungspfade angesammelt haben (ETFs, große Techwerte, das Stillhalten der Bevölkerung, Demokratie, Frieden, Klimastabilität) die immer riskantere Wetten stabilisieren (KI, Crypto und was immer Trump da macht), erwarte ich jeden Tag, dass ein Crash eines verdrängten, aber stabilisierenden Fulcrums irgendwo ganz unten im Getriebe den entscheidenden Funken in diesen Zunder springen lässt.

Was wird der Crack gewesen sein? Das kann vieles sein und ich hätte ein paar Fulcren im Blick, aber ich glaube nicht, dass es die richtigen sind, denn die haben andere auch im Blick. Ich bin mir sicher, dass es etwas sein wird, woran ich nicht denke, weil es auch mir es erstmal nicht auf anhieb offensichtlich ist. So ist das mit dem verdrängten Fulcrum [F6]. Ich bin auch betroffen, wie die meisten Expert*innen.

Rückblickend war jeder Crash ein „Failure of Imagination“.

Immobilienmarkt

Fragt man einen Ökonomen, wie sich der Kaufpreis eines Hauses zusammensetzt, würde er vermutlich sagen: „Herstellungskosten + Marge“ und wenn man ihn fragt, wie sich die Marge berechnet, würde er sagen: „Die wird am Markt ermittelt“.

Fragt man die selbe Frage hingehen einen Immobilienmakler, wird er sagen: „Lage, Lage, Lage.“

Makler sind nicht die vertrauenswürdigsten Menschen der Welt, doch in dieser Sache würde ich ihnen eher trauen, als den Ökonomen.

Denn was heißt Lage?

- Gute Verkehrsanbindung

- Gute Einkaufsmöglichkeiten

- Sichere Straßen

- „Gepflegte Gegend“

- Gute Schulen für die Kinder in der Nähe

- Gutes Kulturangebot

- Nette Nachbarschaft

- Parks

- Anbindung an Freizeitmöglichkeiten, etc.

Lage heißt leichte Integration von Pfadgelegenheiten, wenn man dort wohnt.

Auch wohnen ist Hebeln. Man leveraged eine Infrastruktur zur zeitweisen und möglichst angenehmen Beherbergung seines Körpers. Es ist somit auch immer mehr als nur Geld, dass man in eine Immobilie investiert.

Ein Teil des Werts des Wohnungs-Hebels bestimmt sich durch die Hebel, die dadurch erreichbar werden, was das Fulcrum des Hauswerts – ähnlich wie die Abhängigkeiten des Unternehmens – erweitert/stabilisiert. Die Abhängigkeiten des Hauswertes bestehen nicht nur aus funktionierender Anbindung an Wasserleitungen und Strom, sondern es addieren sich auch die „erreichbaren“ Infrastrukturen drumrum.

Eine Investition in ein Haus ist also immer schon mehr als eine Investition in das Haus ansich, sondern auch in die Gegend und das heißt ganz oft in die „öffentlich finanzierten Infrastrukturen“, nur dass das Geld da nie ankommt, sondern beim verkaufenden oder vermietenden Kapitalisten landet.

Im Kapitalismus ist es egal, wer den Wert schafft, wichtig ist, wer die Hebel zur Abschöpfung hat.

Und ist es nicht witzig, wie all das, was wir als Fulcrum identifizieren und beschreiben, ziemlich Deckungsgleich mit dem ist, was in der klassischen Ökonomie als „Externalität“ verdrängt wird. Turns out: Die „Externalität“ ist das, worum es geht.

„Der Markt“ ist wie die Oberfläche eines Sees der hunderte Meter tief ist und deren Oberflächenphänomene vollkommen durch die Ereignisse unter Wasser determiniert sind. Die Klassische Ökonomie fordert uns auf, unsere Aufmerksamkeit den Oberflächenphänomen zu widmen. Doch folgen wir den Infrastrukturen, tauchen ein ins Wasser, stoßen wir auf Fulcren, auf Fulcren auf Fulcren, aber alle enden in Schmerzmühlen an den Engstellen der Wertflüsse.

Die klassische Ökonomie ist unterparametrisiert, weil ihre Aufgabe ist, Macht zu verschleiern.

Teil III: Die „Realwirtschaft“

Die „Realwirtschaft“ agiert zwar nicht unabhängig von der Finanzwelt, aber ist besser beschrieben, als ein Netzwerk aus Infrastrukturen und unseren Nutzenserwartungen daran. Denn auch wir hebeln täglich Konsumentenmarge aus unseren Pfadgelegenheiten und schlürfen dabei den Wert aus den Fulcren.

Dabei ist zu beachten, dass auch materielle Infrastrukturen „beliehene“ Fulcren sind, sie operieren also ebenso im Raum der Erwartungen und Erwartungserwartungen, wie ich im Fulcrums-Explainer anhand der Verbreitung des Linienflugs zeige.

Wir erwarten, dass der Hebel/die Pfadgelegenheit funktioniert (die Straße befahrbar ist, meine Überweisungen ankommen, der Server erreichbar ist) nicht (nur) weil es unseren eigenen Erfahrungen entspricht, sondern auch weil es eine „allgemeine Erwartung“ ist, die sich bei genauerem Hinsehen immer als eine konkret aquirierte Erwartung von anderen herausstellt, die wir uns angewöhnt haben, zu beleihen, weil uns die Realität (noch) keinen Strich durch die Rechnung gemacht hat, bzw. andersrum: jede unserer Erfahrung einer geglückten Hebelaktion re-inforced die Wertzuschreibung, die wir andernorts aquirierten.

Q-Function ist sozial.

Dass Pfadgelegenheiten gesellschaftlich für „einiger maßen sicher“ befundene Infrastruktur sind, kann man gut am Adaptionsprozess neuer Pfadgelenheiten beobachten.

Als die Pfadgelegenheit „Linienflug“ eingeführt wurde, musste das Vertrauen in diese Infrastruktur erst mühsam durch die Gesellschaft perkulieren. Das dauerte bis alle irgendjemand kannten „der schon mal geflogen ist“. So akkumuliert sich investiertes Vertrauen in Infrastruktur und diese Erwartungsstabilität ist das Fulcrum, das den Linienflüge im heutigen Maßstab ermöglicht.

Der Mensch

Jeder Mensch hat ein Fulcrum, also notwendige Vorbedingungen des Überlebens, die regelmäßig aktualisiert werden müssen.

Die Reproduktionsnotwendigkeiten des menschlichen Körpers ist das stabilisierende Fulcrum [F5] der gesamten Erwartungskette – sie erden das Modell in etwas Materiellem, das nicht wegerwartbar ist.

Macht konzentriert sich deswegen strukturell „nah am Menschen“, an den Engstellen zwischen diesem körperlichen Basalfulcrum und den Pfadgelegenheiten, die es bedienen. Wohnen, Nahrung, Energie, Gesundheit – wer dort Netzwerkzentralität hat, hebelt die härteste Marge, weil das Fulcrum des Gegenübers am wenigsten verhandelbar ist. Das erklärt auch, warum Vermieter, Energiekonzerne und Lebensmitteloligopole so stabile Margen haben – sie sitzen auf dem kürzesten Pfad zum härtesten Fulcrum.

Gleichzeitig ist das der wesentliche Grund, warum die Margen, die Arbeitshandlungen geleveraged werden, so hoch sind: Die Arbeitenden haben im Gegensatz zum Kapitalisten keinen Exit in der Verhandlung, denn sie müssen ihr Fulcrum finanzieren.

Jeder Mensch ist ein Pfad in der Infrastruktur. Er hat eine Vergangenheit (Pfadabhängigkeiten) und eine Gegenwart (Pfadgelegenheiten) und navigiert so – Schritt für Schritt durch sein Leben.

Jeder Mensch hat eine Perspektive und in dieser Perspektive entsteht bei jedem Nehmen einer Pfadgelegenheit/jeder Nutzung eines Hebels auf ein Fulcrum eine „Nutzenerfahrung“, die Eingebettet ist in die erwarteten Werterwartungen anderer.

Das Ökosystem

Jeder Mensch wohnt auf einer Erde und ist von einer stabilen Umlaufbahn des Planeten um die Sonne abhängig, sowie von der Erdanziehung, den Gesteinsschichten, einem fruchtbaren Boden und das Ökosystem, dass es aufrechterhält, sowie von einer Stablilität und Berechenbarkeit des Klimas und der Ökosysteme der Meere.

Jede unserer Handlungen leveraged immer auch das gesamte Ökosystem und dessen Stablität als verdrängtes, stablisierendes Fulcrum der Wette. [F3, F5, F6].

Landwirtschaft

Einer der untersten Wertpfade kommt aus dem Boden. Es ist der Erneuerungskreislauf der Natur (Stickstoffkreislauf, Kohlenstoffkreislauf, Wasserzyklus, Bestäubungsnetzwerke), von Pflanzen und Tieren, die man – aus Usersicht – essen kann.

Landwirtschaft ist der technologische Pfad, Praktiken und Techniken zu entwickeln (Pflug, Züchtung, Organisation, Dünger, Haber–Bosch-Prozess, Pestizide, Genetik), um diesen Erneuerungskreislauf besser zu leveragen, das heißt: „Produktiver“, Erwartbarer, skalierbarer, usw. um mehr „Marge“ daraus zu pressen.

Unternehmen wie Monsanto versuchen durch Patente zugriffliches Fulcrum [F1] auf bestimmte genetische Reproduktions-Zyklen über das Rechtssystem zu erlangen, damit sie die geschaffene genetische Hegemonie [F2] und die durch sie geschaffenen Wertpfade noch besser leveragen können.

Derweil versanden immer mehr Böden als abgeschriebene Fulcren [F9], weil der Boden landwirtschaftlich überleveraged wurde und gebrochen ist [F8] und all das trägt zum Artensterben bei. Es gibt unterschiedliche Einschätzungen darüber, wie Netzwerkzental die Bestäubungspfade der Wildbienen, Fliegen und Käfer jeweils als stablisierendes Fulcrum [F5] unserer Nahrungspfade sind, aber wenn sie demnächst aussterben, werden wir es ja sehen. Yolo!

Care

Ein Großteil des Wertflusses in der Ökonomie ist nicht mit einer Transaktion behaftet, sondern geschieht „freiwillig“ und unbezahlt. Aus Liebe, oder weil es halt gemacht werden muss, denn sonst tut es keiner. Diese Form der Fulcrumsaktualisierung nennen wir Care.

Feministische Theorien der Ökonomie haben seit jeher darauf hingewiesen, dass Wirtschaftsbeschreibungen von privilegierten Männern den Care Bereich gerne systematisch ausblenden.

Zur Verteidigung: Care ist deswegen in beinahe allen ökonomischen Theorien ein übersehener Riese, weil ihn seine Transaktionslosigkeit als Machteffekt aus der Wahrnehmung über Zahlen schubst. Es ist das alte Problem, dass man seinen Schlüssel unter der Laterne sucht, obwohl man ihn wo anders im Dunkeln verloren hat, aber da kann man ja nicht suchen?

Liberale Theorien der Wirtschaft blenden das Care-Fulcrum der Hebel aus, die sie beschreiben und auch der Marxismus macht da keine Ausnahme, wie ich in Krasse Links No 57 schreibe.

Ich bin mir auch deswegen so sicher, dass der Marxismus eine liberale Theorie ist, weil er ein zentrales Wesensmerkmal des Liberalismus geerbt hat, nämlich die Infrastrukturvergessenheit. Indem Marx die Wertschöpfung der Gesellschaft ausschließlich in der Produktion suchte, übersah er den Großteil der Wertschöpfung, der sich komplett jenseits von Fabriken, Maschinen und Tauschwerten abspielt, nämlich zu hause, in der Waschküche, der Schule, beim Kinderfüttern und Erziehen.

So ging das weiter: Liberale Infrastrukturvergessenheit gegenüber kolonialen Abhängigkeiten, Infrastrukturvergessenheit gegenüber ökologischen Abhängigkeiten, Infrastrukturvergessenheit gegenüber semantischen Abhängigkeiten („KI“), etc.

Die Unsichtbarkeit von Care ist ein Resultat ihrer Erwartbarkeit. Alles was „erwartbar“ ist, wird automatisch zum stablisierenden Fulcrum [F5] und damit zum verbuchten Fulcrum [F7] bald danach zum verdrängten Fulcrum [F6].

Im Grunde gibt es zwei Arten mit Machtungleichgewichten (z.B. A ist abhängiger von B, als umgekehrt) umzugehen:

- B kann aus der Abhängigkeit von A Marge pressen (Kapitalismus)

- B kann sich um A kümmern. (Care)

Dazu mehr im Wert/Macht-Formel-Explainer.

Mit jeder Hebelhandlung leveraged du einige tausend Stunden unbezahlter Carearbeit, denn Care ist das stablisiernde, aber verdrängte Fulcrum [F5, F6] aller kapitalistischen Hebelhandlungen.

Die Organisation

Ich schlage für die „Organisation“ (also auch Unternehmen) ein Input/Output-Modell nach Pfeffer und Salancik, The External Control of Organizations: A Resource Dependence Perspective vor.

Aus dem Plattformbuch:

Ende der 1970er kam eine Wirtschaftstheorie auf, die der neoklassischen Lehre ein völlig verändertes Paradigma gegenüberstellte: die Resource Dependence Theory (RDT), auch Ressourcenabhängigkeitsansatz. Sie wurde im Wesentlichen von Jeffrey Pfeffer und Gerald R. Salancik in ihrem Buch External Control of Organizations ausformuliert. Darin zeigen sie, wie Organisationen ihre Entscheidungen in der Realität weniger auf Gewinnoptimierung ausrichten, sondern vor allem auf die Sicherung des eigenen Weiterbestehens. Den Schlüssel dafür sehen Pfeffer und Salancik wiederum in der Fähigkeit einer Organisation, “Ressourcen zu akquirieren und zu sichern“.

Bis dahin hatte sich die Wirtschaftswissenschaft darauf konzentriert, wie sich Ressourcen optimal einsetzen ließen. Doch Ressourcen sind nicht nur knapp, sondern der Zugang zu ihnen ist vor allem unsicher. Stellen wir uns einen Autobauer vor, der ein spezielles Ventilsystem in seinen Motor einsetzt, das nur von einem spezialisierten Zulieferer hergestellt wird. Passiert diesem irgendetwas, das die Lieferung des Ventilsystems unterbricht, steht sofort die ganze Produktion still, und das Unternehmen gerät vielleicht sogar in existentielle Gefahr. Wichtiger als kostengünstige Ressourcen ist also ein zuverlässiger Zugang zu Ressourcen.Um die Existenz der Organisation zu gewährleisten, muss daher immer erst der Ressourcenzugang hergestellt und gesichert werden, wobei Ressourcen alles sein können: Rohstoffe, Vorprodukte, qualifizierte Mitarbeiter*innen, Liquidität, politischer Rückhalt, öffentliche Wahrnehmung, Markt- und Kundenzugang. Mit anderen Worten: Jede Organisation muss mit ihrer Umwelt in vielerlei Abhängigkeitsbeziehungen treten, und das Management dieser Abhängigkeitsbeziehungen bestimmt ganz wesentlich die Struktur der Organisation. „Organisationen sind weniger konkrete soziale Entitäten als vielmehr ein Prozess zur Organisation von hinreichender Unterstützung, um die eigene Existenz fortzuschreiben“, so Pfeffer und Salancik. Und so können beiden belegen, dass diejenigen die wichtigsten und oft bestbezahlten Funktionen in einer Organisation besetzen, die sich als fähig erweisen, die entscheidenden Ressourcen zu sichern und Abhängigkeiten zu reduzieren.

Im Grunde ist der ganze Explainer eine ausgefaltete RDT.

Nutzen/Wert

In Krasse Links No 73 formulierte ich meine Erkenntnisse zu Nutzen und Wert.

Genau deswegen halte ich es für so wichtig, sich Wirtschaft als Abhängigkeitsnetzwerk vorzustellen. Produkte, Services oder Ressourcen haben keinen Wert ansich, durch sie fließt Wert/Nutzen. „Nutzen“ empfinden wir in dem kurzen Moment, bei dem aus einer Sache, in Kombination unseres infrastrukturellen Kontextes und aus unserer jeweiligen Perspektive eine „Pfadgelegenheit“ entsteht.

Ich „will“ nicht diesen Schraubenzieher, ich will, dass die Spühlmaschine wieder läuft, damit ich meinen Abwasch machen kann, damit ich morgen aus dem Haus kann, ohne mir Gedanken zu machen, um dann auf die Arbeit zu fahren, um Geld zu verdienen, um mir einen Schraubenzieher kaufen zu können.

„Wert“ ist ganz grob gesprochen die Summe des erwarteten Nutzens einer Sache für jemandem in seinem spezifischen materiellen Kontext und seinem spezfischen semantischen Kontext – mit seinem spezifischen Wissen, seiner spezifischen kulturellen Prägung, seinen spezifischen Plänen, etc. Auf das Dividuum runtergebrochen ist es also eine Aggregation über alle von der Sache erwarteten Pfadgelegenheiten hinweg, geteilt durch die Pfadalternativen + 1. Das rechnet man natürlich nicht im Kopf aus, sondern imaginiert es, bis man es durch den Schmerz ihres Fehlens erfährt.

(Wir kennen die Formel bereits als unvollendete Plattformmachtformel und ich denke, sie passt ganz prima auf den „Wert“ von Dingen. Wert ist die Macht, die eine Sache über uns hat.)Die Sache und damit ein Großteil des „Wert/Nutzen“ entsteht in einem anderen Netzwerk, den Pfad der Produktion, und dort über die gesamten dafür notwendigen Infrastrukturen hinweg, die den Schraubenzieher möglich und in der konkreten Situation nützlich machen und das inkludiert die lockere Schraube in der Spülmaschine, den Baumarkt, wo ich den Schraubenzieher gekauft habe, aber auch den Hersteller, den Zulieferer und deren Arbeiter*innen und deren Familienmitglieder, die den Haushalt schmeißen, ihre Wohnungen und ihren Warenkorb zum sattwerden, das Land, auf dem die Fabrik steht und das Land aus dem die nötigen Bodenschätze kommen und natürlich das Ökosystem, in dem all das eingebettet ist.

Aber dieses Netzwerk ist hierarchisch. Netzwerkknoten die weit unten liegen und sich schwer ersetzen lassen, haben einen überproportionalen Effekt auf alle nachgelagerten Pfadgelegenheiten. Wenn Energie teurer wird, ist die Übergangswahrscheinlichkeit auf andere Sektoren groß, denn Wohnen, die Produktion von Lebensmitteln und den ganze Rest der Pfadgelegenheiten ist stark von Energieflüssen abhängig. Dasselbe gilt etwas abgeschwächt für Lebensmittel und Wohnen. Werden die Grundbedürfnisse der Menschen teurer wird ihre Arbeit teurer, oder – wie es eigentlich läuft: Arbeiter*innen werden ärmer.

Gegencheck: Adam Smith‘ Diamant–Wasser-Paradoxon

In „The Wealth of Nations“ formuliert Adam Smith das Wertproblem anhand eines Vergleichs zwischen Wasser und Diamanten.

Nothing is more useful than water: but it will purchase scarcely anything; scarcely anything can be had in exchange for it. A diamond, on the contrary, has scarcely any use-value; but a very great quantity of other goods may frequently be had in exchange for it.

Alle Schulen, die eine Wirtschaftstheorie formulierten, versuchten sich an diesem Paradox, die Klassiker selbst (Smith, Ricardo), Marginalisten (Carl Menger, Jevons), außerdem Hayek und viele andere. Mich hat bisher keine überzeugt.

Hier ist die Antwort der Politischen Ökonomie der Pfadgelegenheiten.

Wert ist perspektivisch und situativ.

Das heißt, mit unserer Wertformel lassen sich unterschiedliche relational materielle Szenarien zeichnen und darin Perspektiven formulieren.

Die Perspektive, die wir kennen: Wasser (eine konkrete Wasserquelle) hat für uns deswegen keinen großen „Wert“, weil die Pfadalternativen vielfältig sind und sich – Perspektive des Kapitalisten: dieses Fulcrum also nicht leveragen lässt.

Der Science Fiction Film „Mad Max: Fury Road“ von 2015 zeigt eine Welt, in der Wasser als knappe Ressource (neben Benzin) für Macht leveragebar wird. Wenn es gelingt, das zugriffliche Fulcrum [F1] für Wasser zu kontrollieren, wird Wasser kostbarer als jeder Diamant, denn die Fulcrumsabhängigkeit der Menschen von Wasser ist nicht bypassbar. Stellt man sich den Zufluss von Wasser im Wertpfad vor, dann bedeutet ein Abschneiden dieses Pfades über kurz oder lang das Abschneiden aller Pfadgelegenheiten. Ende. Der ultimative Preis.

Und das ist keine Fiktion. Schon heute leveragen große Unternehmen den Zugang zu Wasser in vielen Teilen der Welt. Die Tatsache, dass wir in weiten Teilen Deutschlands das Wasser aus der Leitung trinken können ist keine Selbstverständlichkeit. Wir hatten Glück, dass unser Wassersystem, geplant und entworfen wurde, als der Neoliberalismus noch nicht erfunden war und die Vorzüge öffentlicher Infrastruktur noch bekannt. Der Grund, warum wir für diese Pfadgelegenheit keine Margen an Oligarchen zahlen (müssen), ist der billige und allgegenwärtige „Exit“ des Wasserhahns. Gäbe es ihn nicht, wäre das Kontaktzonen-Fulcrum [F4] der Abhängigkeitsbeziehungen stabil genug, um auch hier ordentlich Marge zu hebeln.

Es wäre aufwändig, aber technisch trivial und durchaus leistbar, überall eine Wasserinfrastruktur für trinkbares Wasser zu bauen und mit Kontrollhebeln die Wasserqualität aufrecht zu erhalten, die jeden erreicht. Aber wie man in den entsprechenden Länder schaut, ergibt sich ein anderes Problem: Haben sich die drei Oligarchen im Trenchcoat erstmal am zugrifflichen Fulcrum einer so netzwerkzentalen Ressource eingenistet, ist es politisch schwierig bis unmöglich sie wieder loszuwerden, weil sie den gewonnen gesellschaftlichen Einfluss und ihre gehebelte Marge dazu nutzen, die Politik genau davon abzubringen.

Auf der anderen Seite zeugt es von einer Ignoranz gesellschaftlicher Verhältnisse, zu behaupten Diamanten hätten kein „use-value“. Ein Diamant hat in bestimmten Kontexten einen enormen semantischen Pfadgelegenheitswert und eröffnet Pfade zu Heiraten und Statusgewinnen. Das Besondere des Diamanten (ähnlich wie bei Gold und anderen Statusprodukten), ist, dass die Knappheit (struktureller Mangel an Pfadalternativen) auf den Wertpfad positiv einzahlt, weil er das zugriffliche Fulcrum [F1] preislich auf eine Ebene hebt, die eine „soziale Exklusion“ und damit eine semantische „Distiktion“ im Netz der Erwartungserwartungen erlaubt.

Konsum

Es gibt viele unterschiedliche Arten von Pfadgelegenheiten, aber zwei der wichtigsten sind die Onramp und die Offramp. Die Onramp etabliert eine habituelle Hebelnutzung, die Offramp gewöhnt sie sich ab. Die Offramp kann abrupt kommen, wenn die Infrastruktur nicht mehr verfügbar ist, aber ansonsten braucht sie eine Pfadalternative als Argument: d.h. Einen inszenierten Pfad ohne, bzw. mit subsituierendem Pfad.

Die Pfadgelegenheit „aktualisiert“ sich nun auf zwei Arten: Dem horizontalen Nutzenpfad (immer wenn ich die Pfadgelegenheit nutze, aktualisiert sich das Nutzenportfolio) und dem vertikalen Wertpfad (immer wenn die Pfadgelegenheit erneuert werden muss, aktualisierung des Wertportfolios). Am einfachsten ist es mit der Zahnpasta, die ich in regelmäßigen Abstände kaufe und in noch regelmäßigen Abständen nutze, aber das gilt auch für den Gehweg vor meinem Haus, oder für den Computer, mit dem ich das hier schreibe, oder die Demokratie, die unter unseren Füßen zusammenbricht, weil sie so lange nicht mehr erneuert wurde.

Der Hebel besorgt den Nutzen, das Fulcrum besorgt den Wert. Der Wertfluss aus den Lieferketten, Fabriken, Fließbändern und Händen stabilisiert den Wert der Pfadgelegenheit auf der einen Seite und produziert Reproduktionskosten auf der anderen.

Man könnte meinen der Wertpfad ist hier zu ende, aber hier kommt erst das wichtigste: Der Wert wird nicht in der Arbeit produziert, sondern im Konsum: in der Nutzenaktualisierung wird der Wert erst hergestellt. Der tatsächliche Wert entsteht nicht im Arbeitsinput, sondern am Konsumoutput.

Der subjektive Wert einer Pfadgelegenheit ist der Wertpfad aus all den Pfadgelegenheiten, die ich in ihm sehe. Und der Wertpfad, der unten an ihn anschließt wird von dem Wertpfad oben „angesaugt“. Die Aktualisierung des Wertpfades ist dennoch wichtig, denn sonst ist die Pfadgelegenheit pfutsch. Und der ganze Wertpfad besteht, bei genauerer Betrachtung auf jeder Ebene ebenfalls aus Nutzenereignissen von Hebeln, die für die materielle Aktualisierung meiner Pfadgelgenheit ungelegt werden mussten.

Der „Wert“ entsteht im Nutzen, bzw. er besteht aus „erwartetem Nutzen“, aber jeder Nutzen erzeugt eine Aktualisierungsnotwendigkeit. Diese Aktualisierungsnotwendigkeit aqiuriert Wert aus dem Fulcrum (saugt), das diesen Wert auf jeder seiner Ebenen wieder durch Nutzenereignisse herstellt, die selbst wieder Wert aus unteren Layern saugt und so weiter.

Wert ist keine Substanz die „in“ Dingen steckt, sondern ein Erwartungsgradient, der durch antizipierte Nutzenereignisse aufgespannt wird – und dieser Gradient erzeugt einen Sog durch die gesamte Produktionskette (vermittelt durch Geld), der sich auf jeder Ebene als Ansammlung lokaler Nutzenereignisse realisiert.

Für Marxist*innen: Man kann einen einfachen Test machen: Würde sich sonst nichts ändern, aber die Arbeitenden würden alle 10 % mehr arbeiten, würde dann mehr Wert „produziert“?

Ich würde behaupten: nur dann, wenn die zusätzlichen Arbeitsergebnisse auch genutzt werden.

Würden hingegen die Nutzenden, eine sonst gleiche Infrastruktur um 10 % mehr nutzen, würde ich behaupten, dass 10% an zusätzlichem Wert in der Welt wäre.

„Wert“ entsteht nicht materiell, sondern entspringt immer dividuellen Perspektiven und bleibt daran gekoppelt. Deswegen kann ein von Arbeit unberührter Wald wertvoll sein und ein Haufen 4 Jahre alter Nvidea-Grafikkarten nicht.

Der relationale Materialismus behauptet eine Pull-Theorie des Werts statt der Push-Theorie, wie der Marxismus.

Die Differenz von „Wert“ und seinen Aktualisierungskosten nennen wir die „Konsumentenmarge“.

Und ja, das heißt, wir alle sind „Sucker“.

Nachfrage und Preise

Der Nutzen der Dividuen schlürft an den Werthamlen und die Aktualisierungskosten sind die notwendige Saugstärke, die dafür aufgebracht werden muss.

Die nötige Saugstärke, die der Nutzenfluss erfordert, wird von den Oligarchen durch die „Preise“ kontrolliert. Aus Sicht des Kapitalisten sieht die Sache so aus:

Die Kapitalistenmarge ist die Differenz zwischen Input-Kosten und leveragebarer aggregierter Saugstärke.

Wie weit man die die Marge ausweiten kann, zeigen Erfahrungen, aber Modelle eher schlecht, weil sie das Problem nicht verstehen. Aber weil auch Kapitalisten Dividuen sind, orientieren sich die Preise meist an den Preisen der Wettbewerber.

Ich folge damit einer Beobachtung des politischen Ökonomen Frederic S. Lee, der einfach hingegangen ist und nachgefragt hat, wie Preise gesetzt werden. In Krasse Links No 21 hatte ich sein Werk besprochen.

Eine der zentralen Streitfragen in der Ökonomie kreist um die Frage, wie Preise entstehen. Marx sah im Preis den Tauschwert abgebildet, der wiederum die in der Ware enthalte Arbeitsleistung repräsentiere. Die klassischen Ökonom*innen sehen dagegen den Preis als Ergebnis des dynamischen Sich-Verhaltens von Nachfrage und Angebot. Angebot ist klar, aber die Nachfragekurve definiert sich dabei als der aufaddierte „Marginalnutzen“ den Konsument*innen aus der Ware ziehen, wobei „Marginalnutzen“ die Tatsache abbilden soll, dass das dritte Eis in Folge weniger Spaß macht, als das erste, usw.

Diese unnötig komplizierten (und nebenbei empirisch unüberprüfbaren) Theorien entkräftete Lee, indem er einfach mal nachgefragt hat. Im direkten Widerspruch zum neoklassischen Modell, bei dem der Preis jederzeit in der Aushandlung ist und den Anbietern als definitives Signal gilt, an dem sie ihre Preisgestaltung orientieren, werden Preise in der Realwelt von Menschen gesetzt und haben eine enorme Stabilität gegenüber Änderungen von Angebot und Nachfrage. Unternehmen interessieren sich bei der Preisgestaltung recht wenig für Marginalnutzen und Nachfragekurve und nichtmal primär für Gewinn, sondern richten ihr Handeln im wesentlichen darauf aus, auch morgen noch zu existieren, weswegen die Kostendeckung natürlich Front and Center jeder Preisgestaltung ist. Und selbst bei Überlegungen, welche Marge man noch draufschlägt, sind selten Gewinnmaximierungsfragen, sondern meist strategische Überlegungen relevant. Will ich den Marktanteil vergrößern, was will ich meinen Kund*innen oder meinen Investoren signalisieren? Wann macht es Sinn sich auf einen Preiskampf einzulassen? (Überraschung: so gut wie nie).

Das Ergebnis ist Lees „Administered Prices Theory“ und die zusätzliche Beobachtung, dass Preise zwar schon auch der Kommunikation dienen, aber der Kommunikation zwischen Konkurrierenden Unternehmen. In der Realität schält sich nämlich immer ein oder zwei „Price-Leader“ heraus, an dem sich alle anderen Unternehmen orientieren.

„there is absolutely no regular relationship between variations in demand, supply, and price. Prices simply aren’t functioning as they are supposed to according to marginalist theory—changing when demand shifts, signaling what and how much agents must now buy or produce—because they have completely different purposes instead. The price mechanism that’s supposed to allocate resources in the economy isn’t distorted by imperfections, it isn’t the ideal from which reality diverges—it simply does not exist.“

Auch Kapitalisten trommeln sich mit Preisen Nachrichten zu.

Weil auch Kapitalisten keine Indviduen sind, die mit ihrer „Intelligenz“ jederzeit den „besten Preis“ kalkulieren, sondern Dividuen, die auf den Erwartungen der anderen surfen, sind Preisstablität und sozialer Orientierungssinn „eigentlich“ der Weg, wie Preise gemacht werden (Sonderfall „Finanzmarkt“).

Der Markt

Aber was ist der Markt aus „Usersicht“?

Das sind die Regale im Supermarkt, das sind Saturn und Kaufhof am Alex und das ist natürlich Amazon Marketplace, das sind die vielen anderen Internetseiten und Angebote.

„Der Markt“ ist also zunächst einmal eine künstlich hergestellte „Choice Architecture“, durch die die Kapitalisten unsere Pfade vorstrukturieren.

Hinter jeder dieser „Choice Architectures“ steckt der Wertpfad, das ausufernde Fulcrum von Lieferketten, Lager und Produktionsketten, die die „Choice Architecture“ am Leben halten, indem sie sie stetig auffüllen.

Relational materiell betrachtet, ist „der Markt“ also „Drei Oligarchen im Trenchcoat“.

Und wenn man in Zeitungsartikeln oder in Papern, das Wort „Markt“ mit „Drei Oligarchen im Trenchcoat“ austauscht, dann hat man einige Aha-Erlebnisse.

Drei Oligarchen im Trenchcoat ist wie viele der Begriffe im relationalen Materialismus ein „skalenfreier Begriff“ (z.B. wie Pfadgelegenheit, Hebel:Fulcrum, Erlaubnisstruktur), d.h. er beschreibt ein Muster, keine Sache und das Muster kann in unterschiedlichen Größen; kontexten und Variationen auftreten:

Die drei Brausehersteller, die drei großen Netzbetreiber, die drei Supermarktketten in Laufnähe, die drei Großhändler, die die Supermärkte beliefern, die drei großen social Media Plattformen, die drei großen Kosmetikhersteller, etc.

Inflation

Zurück zur „Nachfrage“, also dem preisgesteuerten Saugdruck am Konsumende des Wertpfads und schauen, was passiert, wenn der Kapitalist an der Preisschraube dreht: Wenn er seine angebotenen Pfadgelegenheiten ordentlich Konkurrenz haben, werden manche Konsumierenden auf Pfadalternativen switchen (Exit), wenn er keine oder wenig Konkurrenz hat, werden die Leute das „erdulden“ (Loyalty) oder sich öffentlich beschweren (Voice).

Aber meist ist die „Marktsituation“ irgendwas zwischen „Monopol“ und „kompetitivem Markt“? Und Klar treffen sich die drei Oligarchen im Trenchoat auch manchmal auf dem Golfplatz, aber die grundlegende Kommunikation zwischen ihnen passiert über die Preise, die sie setzen. Und uns einzureden, dass der Preis ein Ergebnis einer Voodooberechnung von Angebot und Nachfrage ist (sie haben ja nicht mal ein solides Modell für „Nachfrage“), ist auch eine Ablenkung von diesem Kommunikationssystem.

Und hier, was ich glaube, was nach der Covidkrise wirklich passierte: Echte Lieferengpässe ließen Beschaffungskosten steigen und damit Preise. Aber als die erwarteten Preis-Erwartungen eh durchgeschüttelt waren, also Preisteigerungserwartungen bereits erwartbar waren, leveragten einige der Oligarchen diese Preisteigerungserwartungen als Fulcrum, um ein größeres Stück Konsumentenmarge zu frühstücken.

Sie ließen sich auf ein spontanes Percushen-Konzert ein, in der sie unter wechselseitiger Beobachtung die Preise schrittweise immer wieder höher setzten, als die eigenen Beschaffungskosten stiegen.

Dieser gallopierenden Differenz ist Isabella Weber auf die Spur gekommen.

Supply shocks are now widely recognized as a driver of the recent inflation bout, but the role of firms’ pricing strategies in propagating input cost shocks remains contested. In this paper, we review the state of the academic debate over sellers’ inflation and assess whether, in line with this theory, economy-wide cost shocks have functioned as an implicit coordination mechanism for firms to hike prices. We use a dataset containing 138,962 corporate earnings call transcripts of 4,823 stock-market listed U.S. corporations from the period 2007-Q1 to 2022-Q2 to con- duct sentiment analysis via both dictionary-based natural language processing and a large language model approach. We find that large input price shocks (as well as their co-occurrence with supply constraints) correlate with positive sentiments expressed in executives’ statements about cost increases. Qualitative analysis pro- vides further insights into the reasoning behind executives’ optimism regarding their ability to turn an economy-wide cost shock into an opportunity to raise prices and protect or even increase profits.

Kapitalismus/Eigentum

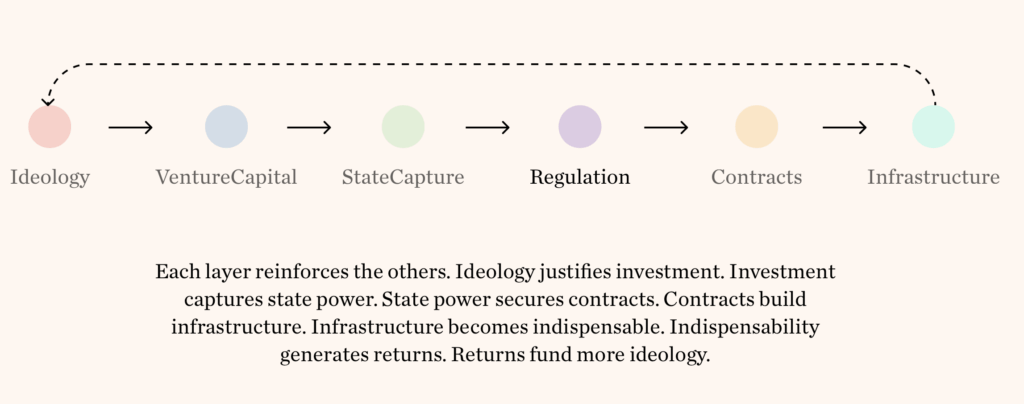

Kapitalismus ist ein Hebelregime, das durch gewaltsam durchgesetzte Eigentumsgarantie leveragebare Netzwerkzentralitäten schafft (Marktfähige Verfügungsgewalt), auf der Marge gehebelt werden kann.

Im Plattformbuch beschreibe ich die Rolle des Eigentums so:

Das Eigentumsprotokoll legt sich wie eine Matrix über die Welt. Es ist ein artifizielles Adressschema, das jedem Ding in der Welt eine*n Eigentümer*in zuweist, ganz so wie das Internet Protocol jedem Gerät im Internet eine IP-Adresse. In einer Welt, in der das Eigentumsprotokoll hegemonial ist, muss alles jemandem gehören.

Über die Graphnahme des Eigentums ist viel geschrieben worden. Exemplarisch wird immer wieder auf die Einhegungen des Allmendebesitzes Mitte des 17. Jahrhunderts in England verwiesen. Ein Vorgang, der von Marx im Kapital halbsarkastisch als „ursprüngliche Akkumulation“ bezeichnet wird und den auch Karl Polanyi in The Great Transformation als die Grundbedingung für die Entstehung der Marktwirtschaft identifiziert. Das Eigentumsprotokoll wurde spätestens mit der europäischen Kolonialherrschaft weltweit hegemonial und setzte sich nicht zufällig immer in Kombination mit dem Konzept des Nationalstaates durch, als globaler Standard der territorialen Herrschaft. Staatliche Souveränität und Eigentum sind ein Geschwisterpaar.Denn Eigentum als Protokollplattform ist nicht souverän. Es muss sich immer der Gewalt des Staates bedienen, um seinen Graphen abzusichern. Der Staat stellt über den Zugriff auf die menschlichen Körper die Level-I-Kontrolle des Eigentumsprotokolls her. Erst über diesen Umweg werden individuelle Zugangsregime zu Land, Gebäuden, Maschinen und Waren ermöglicht und somit auch die marktfähige Verfügungsgewalt ihrer Eigentümer*innen.

Im Laufe der Durchsetzung des Eigentumsparadigmas wird vielerorts auch die Leibeigenschaft aufgehoben, und erstmals werden Bürgerrechte definiert und eingeführt. Gleichzeitig werden etablierte Sozialmaßnahmen gegenüber Armen und Bedürftigen gestrichen. Der Arbeiter wird dadurch doppelt frei, wie Marx es ausdrückt: einerseits frei von der Knechtschaft durch den Lehnsherren, andererseits frei, für Lohn zu arbeiten oder alternativ zu verhungern. Das Bürgerrecht ist sozusagen das Eigentumsrecht des kleinen Mannes an sich selbst, zugleich entlässt es ihn aus dem Verantwortungsbereich einer paternalistischen, aber doch auch fürsorglichen Sozialstruktur. Das Resultat ist eine Kompatibilität der Körper mit dem Eigentumsprotokoll: Die doppelte Freiheit kreiert das Individuum und beschert ihm ein rechtebasiertes Zugangsregime zum eigenen Körper, das es ihm ermöglicht, marktfähige Verfügungsgewalt über die eigene Arbeitskraft zu erlangen.

Das eigentliche Wunder passiert aber erst als Resultat dieser doppelten Graphnahme von Dingen und Körpern: Durch die Hegemonialität des Eigentumsregimes und seiner staatlichen Absicherung der Level-I-Kontrolle wird Level II ermöglicht. Wir erinnern uns: Level I sind die erwarteten Vorselektionen potentieller Verbindungen, die Level II – die unerwarteten Anschlussselektionen konkreter Verbindungen – wahrscheinlicher machen. Die konkreten Verbindungen sind hier die Transaktionen, Geschäfte und Verträge, deren Gesamtheit abstrakt als „der Markt“ bezeichnet werden. Der Markt ist eine vertikale Iteration aus dem Eigentumsgraphen.

Dieses Konstrukt aus Eigentum und Bürgerrechten war einerseits ein Versprechen an das entstehende Bürgertum: relative Autarkie qua individuellen Rechten und Eigentumssicherheit. Andererseits – und im größeren Maßstab – ermöglicht es auch die Kontrolle über die Produktionsmittel in den Händen einiger weniger bei gleichzeitiger Notwendigkeit für alle anderen, ihre Arbeitskraft zu verkaufen. Die bekannten Produktionsverhältnisse sind damit hergestellt und alle Zutaten sind beisammen, um den Prozess in Gang zu setzen, den wir Kapitalismus nennen.

Eigentum leveraged das Gewaltmonopol des Staates, um eine Unterscheidung zwischen Eigentum und Besitz durchzusetzen.

Gunnar Heinsohn und Otto Steiger haben ihr Buch Eigentum, Zins und Geld dieser Lücke im wirtschaftswissenschaftlichen Denken gewidmet. Eigentum ist ihrer Meinung nach nicht nur eine notwendige Voraussetzung des Kapitalismus, sondern konstitutiv für ihn. Kapitalismus sei vor allem eine „Eigentumsordnung“, und als solche definiere sie sich durch die Unterscheidung von Besitz und Eigentum. Diese Unterscheidung ist eine vorökonomische, genauer: eine juristische.

Besitz wird allgemein als die Verfügungsgewalt über eine Sache verstanden: Ich bin in der Lage, direkten Einfluss auf diese zu nehmen, solange mich niemand daran hindert. Besitz ist also eine Tatsache, Eigentum ist dagegen ein Rechtstitel. Weil ich als Eigentümer keine direkte Verfügungsgewalt über den Gegenstand ausüben muss, können Besitz und Eigentum auch auseinanderfallen. Ich kann eine Sache, deren Eigentümer ich bin, jederzeit in den Besitz von jemand anders geben, es verleihen, verpfänden, etc., ohne dass ich das Eigentum daran verliere, denn die Besitzerin ist verpflichtet, sie mir auf Wunsch wieder auszuhändigen.

An dieser Stelle wird klar, dass die Unterscheidung zwischen Besitz und Eigentum gewisse Voraussetzungen hat. Damit die Besitzerin mir mein Eigentum in jedem Fall zurückgibt, braucht es eine dritte Instanz, deren Macht die Verfügungsgewalt der Besitzerin im Zweifel übersteigt. Dieses Instanz ist gewöhnlich der Staat. Eigentum als abstrakte Rechtsordnung kann es nur geben, wenn es auch ein staatliches Gewaltmonopol gibt, das Eigentumsrechte gegen die Besitzer*innen durchsetzen kann.

Heinsohn und Steiger zufolge ist der moderne Kapitalismus nicht die erste und nicht die einzige Eigentumsgesellschaft. Die erste dürfte ihrer Meinung nach die griechische Polis gewesen sein, aber auch in der römischen Republik habe es Eigentum gegeben. Eine Eigentumsgesellschaft entstehe nicht als evolutionärer Vergesellschaftungsprozess, sondern immer aus einem Akt der Gewalt, sei es eine Revolution oder eine militärische Landnahme. Exemplarisch führen die beiden die Legende von der Gründung Roms an. Als Romulus nach dem gelungenen Aufstand gegen den Feudalfürsten Amulius das befreite Land gleichmäßig unter den Mitstreitern verteilt, überspringt sein Bruder Remus die abgesteckten Grundstücksgrenzen, um ihre Absurdität aufzuzeigen. Das Konzept Eigentum ist Remus – wie den meisten zu jener Zeit – fremd, und so macht er sich über Forderung lustig, abstrakte Grenzen zu respektieren – ist er doch in der Lage, sie zu überschreiten. Romulus erschlägt seinen Bruder und setzt auf diese Weise das römische Eigentumsregime in Kraft.

Aber Eigentum ist auch das Recht ein Fulcrum zu „überleveragen“, wie Eva von Redecker herausgearbeitet hat.

Eva von Redecker hat in ihrem Buch Revolution fürs Leben die Eigentumsform als entscheidende Grundlage für den rücksichtslosen Raubbau an Natur und Menschen ausgemacht. Eigentum, verstanden als absolute Sachherrschaft, gebe der Eigentümerin unbeschränkte Verfügungsmacht über eine Sache. Das schließt ausdrücklich das Recht mit ein, diese Sache auch zerstören zu dürfen. Was das bedeutet, kann man derzeit vielleicht am eindrücklichsten im Amazonas-Regenwald beobachten, wo ein ruchloser Präsident Jair Bolsonaro in Zusammenarbeit mit privaten Investor*innen die grüne Lunge der Welt brandrodet

Geld

Geld ist eine Netzwerkzentralität im Netzwerk der Pfadalternativen (Was kann man gegen was austauschen). Damit nimmt es eine spezifische Netzwerkzentralität innerhalb des Netzwerk der Pfadgelegenheiten ein: Die Liquidität.

Cash ist der generalisierte „Exit“ aus jeder Pfadgelegenheit – sofern Pfadalternativen existieren.

Das gilt funktional aber man darf das nicht zu wörtlich verstehen. Um an Geld zu kommen, muss man sich meist in allerlei andere Abhängigkeiten begeben, die einen bei immer größeren Pfadabhängigkeiten verschulden und das sogenannte „Fuck You Money“ bleibt in der Anwenderpraxis nur eine schöne Theorie.

Geld ist dabei materiell gesehen die vollendete relationale Dematerialisierung – es hat alle kontextspezifischen Verbindungen gekappt, alle Reibung eliminiert, alle Besonderheit abgeschliffen. Es ist reines austauschbares Medium, es ist der ISO-Container der Werterwartung.

Aber genau deshalb ist es relational maximal materialisiert im Sinne von Netzwerkzentralität – weil es mit allem koppelbar ist, ist es überall anschlussfähig. Die vollständige Dematerialisierung auf dem materiellen Level erzeugt die maximale relationale Materialität auf der Erwartungserwartungsebene.

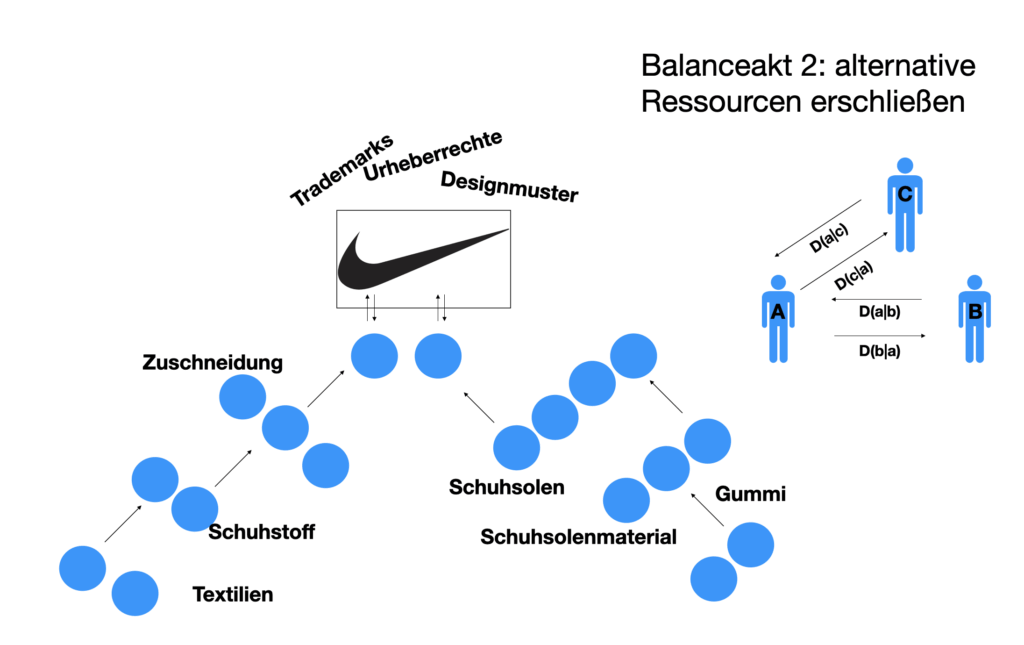

Relationale Dematerialisierung ist kein Endpunkt, sondern ein Prozess der Machtakkumulation. Je weiter dematerialisiert wird, desto universeller einsetzbar, desto zentraler im Netzwerk. Geld ist das Paradebeispiel – aber auch Patente, Markenrechte, AGI folgen derselben Logik. Sie werden auf der materiellen Ebene dematerialisiert um über die Erwartungserwartungsebene universell re-materialisierbar zu sein.

Dollarzentralität

Wir kennen den Effekt davon: Geld regiert die Welt. Aber der „Dollar“ nimmt hier eine besondere Rolle ein.

In Krasse Links No 76 schreibe ich über die Dollarhegemonie anhand eines Papers von Henry Farrell und Daniel Davies über die „weaponization“ der Dollar-Zentralität durch Trump.

Und auch Farrell und Davis merken, dass das alles mit Netzwerkzentralität zu tun hat.

‘Dollar centrality’ is a political-economic concept that refers to the extreme attractiveness of the US dollar as a currency for transactions and investment. […]

The conveniences of dollar centrality for facilitating financial transactions are inseparable from the dollar payment system and its rules as set by the US government. International actors might prefer not to follow these rules, but it would be very painful to lose the enormous benefits of dollar centrality. Many international commercial payments take place in dollars, for ease and convenience. Even those that are not denominated in dollars often touch the dollar payment system, because the dollar is the ‘vehicle’ currency for foreign exchange – a trade of yen for pesos will usually exchange yen for dollars and then dollars for pesos to take advantage of the more liquid dollar markets.

Ich würde konkreter sagen: der Dollar nimmt eine Netzwerkzentralität im Netzwerk der Pfadgelegenheiten ein und das heißt in diesem Zusammenhang konkret, dass man die Pfadgelegenheit Dollar 1.) leichter als jedes andere Geld in alle möglichen anderen Pfadgelegenheiten verwandeln kann (transitive Liquidität) und man 2. Dollar braucht, um einen ganzen Strauß von Pfadgelegenheiten überhaupt nehmen zu können (pfadvoraussetzende Liquidität). Daraus ergibt sich ein erheblicher Lock-In, mit erheblichen Vorteilen für die USA. Alle wollen Dollar und handeln daher mit ihnen, denn das ist der beste Weg, an Dollar zu kommen. Und während alle anderen echte, materielle „Goods & Services“ nach drüben schiffen, müssen die Amerikaner nur das Spreadsheet der Federal Reserve mit Nullen auffüllen, um all das zu bezahlen, wie Cory Doctorow so schön zusammenfasst.

Zunächst wurde dieses Asset von den USA gehegt und gepflegt und es wurde acht darauf gegebenen, dass die Security Agencies der wachsenden Infrastrukturmacht nicht ins Handwerk pfuschen, doch spätestens seit dem 11. September wurde die Dollar-Zentralität immer mehr zum Fulcrum für allerlei Sicherheitshebel, speziell Geldwäscheüberwachung und Sanktionsmechanismen.

Diese Hebel waren langfristig zu attraktiv? Schließlich kann man dadurch nicht nur Banken und Staaten disziplinieren, sondern eigentlich alle wirtschaftlichen Akteure, sofern sie auf Banken angewiesen sind.

Dollar hegemony and US law generated powerful incentives for compliance across the world. Although the legal basis for many actions against non-US actors was surprisingly weak, the fear of being denied access to dollar clearing was sufficient incentive to comply, especially for financial institutions. […]

Financial institutions’ aversion to risk worked as a force multiplier of US coercion. Sanctions compliance, like other forms of anti-money laundering policy but unlike most bank regulation, is enforced by sometimes unpredictable ex post regulatory punishments rather than exante provision of a checklist of required actions.

Doch je mehr diese Hebel bedient werden, desto deutlicher erodiert ihr Fulcrum – also die Akzeptanz der Dollar-Hegemonie. Insbesondere China und die EU werden mittel bis langfristig Pfadalternativen zur Dollarabhängigkeit suchen und schaffen.

This plausible near-future scenario has all the characteristics of a positive feedback loop. Under current circumstances, the EU has strong reasons to do everything it can to escape American hegemony. The US, for its part, has strong reasons to do everything it can to prevent this from happening. The more that the EU tries to get away, the more the US will do to pin it down. In this scenario, there do not appear to be any players, systems, or entities who combine the three necessary features to play a stabilisierung role: the capacity to model the effects of their actions on the overall system, the power to generate sufficiently strong feedback, and the incentive to maintain the current system rather than watch it tear itself apart.

Donald Trump leveraged die Dollarhegemonie bis zum Anschlag, weil, er weiß, dass der Dollar für viele Pfadgelegenheiten kein Exit hat. Aber indem er das macht, erschafft er einen.

Der Wertfluss

Wie auch die Semantik, ist das Netz der Infrastrukuren, also jede Pfadgelegenheit, in zwei Pfade eingebettet: In der Ökonomie ist es der horizontale Nutzenpfad, der den habituellen Akt der Nutzungen aktualisiert. Doch die Pfadgelegenheit wird bereitgestellt und stabilisiert durch einen vertikalen „Wert“-Fluss (entlang der Wetten auf Wetten auf Wetten …), der jede Pfadgelegenheit mit Funktionalität, Sicherheit und Erwartbarkeit ausstattet (Infrastruktur).

Jede plausible Pfadgelehenheit ist etwas „wert“, sonst wäre sie nicht plausibel. Unsere menschliche Q-Fuction haben wir grob definiert als:

Viabilität

+ Gefühl

+ Portfolio

+ Portfolio der Fulcren der Fulcren

+ der imaginierte Pfad/inszenierte Plan

– Kosten

– Risiken

und das alles unter Vorbehalt des „Blicks des Anderen“.

Aber der Pfadgelegenheitswert ist immer nur so lange imaginiert, bis das Fulcrum zusammenbricht und die projizierte Handlung den Infrastrukturvektor nicht mehr beleihen kann. Das Portfolio bricht zusammen und wird dadurch sichtbar.

Jede Pfadgelegenheit ist endlich, das heißt sie muss erneuert werden. Um Straßen, Bahnen, Wasser und Strom kümmern sich Institutionen, Zahnpasta muss ich selbst kaufen, das Haus managed mein Vermieter. Aber jede Pfadgelegenheit, die ich nutze, muss sich erneuern. Der Wert der Infrastruktur muss sich materiell Aktualisieren.

Das bedeutet, dass jede Pfadgelegenheit immer in drei Pfade eingebunden ist: