Willkommen zu Krasse Links No 83. Sattelt euer Alltags-YOLO, heute berechnen wir die Attention Debt von U_scheitert des mimetischen Begehrens im Greenspan Put.

Nachtrag: Die Folge vorgelesen von Ali Hackalife. (€)

Palantir hat auf X eine Art Manifest (Eher das, was wir früher einen „Twitter-Meltdown“ nannten) aufgeschrieben und es ist neben dem Manifest von Andreesen die vielleicht klarste Ausformulierung des Tech-Faschistischen Programms.

Bestehend unter anderem aus unapologetischem Militarismus und kalter Gewaltverherrlichung.

4. The limits of soft power, of soaring rhetoric alone, have been exposed. The ability of free and democratic societies to prevail requires something more than moral appeal. It requires hard power, and hard power in this century will be built on software.

Natürlich gepaart mit KI-Hype.

12. The atomic age is ending. One age of deterrence, the atomic age, is ending, and a new era of deterrence built on A.I. is set to begin.

Einer konkreten „Schlussstrich“-Aufforderung für Europa.

15. The postwar neutering of Germany and Japan must be undone. The defanging of Germany was an overcorrection for which Europe is now paying a heavy price. A similar and highly theatrical commitment to Japanese pacifism will, if maintained, also threaten to shift the balance of power in Asia.

Einer weinerlichen Verteidigung von Elon Musk.

16. We should applaud those who attempt to build where the market has failed to act. The culture almost snickers at Musk’s interest in grand narrative, as if billionaires ought to simply stay in their lane of enriching themselves . . . . Any curiosity or genuine interest in the value of what he has created is essentially dismissed, or perhaps lurks from beneath a thinly veiled scorn.

Und einem ausgesprochenen Kulturchauvismus.

21. Some cultures have produced vital advances; others remain dysfunctional and regressive. All cultures are now equal. Criticism and value judgments are forbidden. Yet this new dogma glosses over the fact that certain cultures and indeed subcultures . . . have produced wonders. Others have proven middling, and worse, regressive and harmful.

Nach Trump wird das die nächste dominante Agenda, vertreten von Vance, Rubio und den Broligarchs. Und in Europa wird man aufatmen und sagen, „die Erwachsenen sind zurück“ und alle Verträge unterschreiben, die ihnen vorgelegt werden.

Raffi Krikorian war mal Manager bei Uber und ist jetzt bei Mozilla und schreibt im Atlantic über den Unfall, den er mit seinem Tesla Autopilot hatte.

One Sunday last fall, my kids and I were on a drive we’d done hundreds of times, winding through the residential streets of the Bay Area to drop my son off at his Boy Scouts meeting. The Tesla was in Full Self-Driving mode, driving perfectly—until it wasn’t.

Wir hatten neulich bereits darüber gesprochen, dass die menschliche Q-Function für KI-Pfade kaputt ist. Es gibt eine Art „Cognitive Surrender“ gegenüber den Ergebnissen von Chatbots. Dasselbe gilt für selbstfahrende Autos und heißt hier „vigilance decrement“.

Full Self-Driving works almost all of the time—Tesla’s fleet of cars with the technology logs millions of miles between serious incidents, by the company’s count. And that’s the problem: We are asking humans to supervise systems designed to make supervision feel pointless. A machine that constantly fails keeps you sharp. A machine that works perfectly needs no oversight. But a machine that works almost perfectly? That’s where the danger lies. After a few hours of flawless performance, research shows, drivers are prone to start overtrusting self-driving systems. After a month of using adaptive cruise control, drivers were more than six times as likely to look at their phone, according to one study from the Insurance Institute for Highway Safety. […]

Psychologists call this the vigilance decrement. Monitoring a nearly perfect system is boring. Boredom leads to mind-wandering. The research is unforgiving: Drivers need five to eight seconds to mentally reengage after an automated driving system gives control back. But emergencies can unfold much faster than that. The driver’s physical reaction might be instantaneous—grabbing the wheel, hitting the brake. But the mental part? Rebuilding context, recognizing what’s wrong, deciding what to do? That takes time your brain doesn’t have.

In dieser Lücke zwischen dem voreiligen Vertrauen in die Technik, der habituell übertragenen Kontolle und der verlernten Möglichkeit des Eingriffs, sitzt die größte Gefahr des Unfalls. Auch Krikorian zieht die Parallele zu Chatbots.

My car didn’t warn me when it was confused. Chatbots don’t, either; they deliver their results in the same confident voice, whether they’re right or hallucinating. They perform expertise, even when the sources they cite are dubious or fabricated. They use technical language in an authoritative tone. And we believe them, because why wouldn’t we? They’ve been right so many times before.

Cars train us mile by mile; AI trains us week by week. In week one, you read a chatbot’s output carefully. By week three, you’re copying and pasting without reading. The errors don’t disappear, but your vigilance does. So does your judgment, until one day you realize that you can’t remember which ideas in a memo were yours and which were generated by AI. What does it say about us that we’ve handed over our thinking so willingly?

Wenn der Autopilot scheiße baut, passiert ein Unfall. Die Unfälle, die wir von KIs erwarten können, werden sich strukturell unterscheiden, weil die Fehler erstmal nicht auffallen und sich im Portfolio unserer unbewussten Wetten als „Attention Debt“ aufaddieren – bis es kracht.

When my car failed, it was immediate and palpable. With chatbots, the failure is silent and invisible. You find out about it later, if at all—after the email is sent, the decision made, the code shipped. By the time you catch the mistake, it’s already out there with your name on it. When the system works, you look efficient. When it fails, your judgment is questioned, sometimes with catastrophic consequences. In 2023, a New York lawyer was sanctioned for citing six cases that didn’t exist. ChatGPT had invented them, but he’d trusted it, and the court blamed him, not the tool. Because a chatbot never gets fired.

We’re experiencing an uncanny valley of autonomy. Computer systems aren’t just almost human; they are almost capable of working on their own. When they fail, someone has to absorb the cost. Right now, that someone is us. But when we pay for a self-driving car or an AI tool, we think we’re buying a finished product, not signing up to test a work in progress.

In der Politischen Ökonomie der Pfadgelegenheiten suche ich immer nach der Q-Function. Q-Function ist ein Begriff aus der KI-Forschung und bezeichnet den „Wert“ einer Pfadgelegenheit innerhalb eines Status eines Spiels. Think Schach: Wie „gut“ ist dieser Zug im Kontext des aktuellen Spielbretts?

Ich versuche immer den Mathepart einfach zu halten, deswegen war meine erste Annäherung:

F(Q) = p x U

wobei „p“ für die Übergangswahrscheinlichkeit steht (mit Werten zwischen 0 und 1), mit der die Pfadgelegenheit gelingt und „U“ für den Nutzen, der sich aus der gelingenden Pfadgelegenheit ergibt, wobei U wiederum eine Abschätzung ist, welche anderen Pfadgelegenheiten durch die betreffende Pfadgelegenheit erreichbar werden, deren Q-Functions also wiederum in die originale Q-Function mit einfließen (So ein bisschen wie bei der Bellman-Gleichung).

Bedenkt man aber, dass jeder Pfad auch ein Risiko beinhaltet, muss man die Formel erweitern. Etwa:

F(Q) = p × U_gelingt + (1−p) × U_scheitert

Wir trennen den Erfolg entlang der Übergangswahrscheinlichkeit p von dem Misserfolg, so dass in den Fällen, in denen die Pfadgelegenheit mißlingt, auch eine andere Nutzenfunktion gilt.

U_scheitert ist im Alltag oft einfach 0 und wir denken den Wert kaum mit, denn wenn eine Pfadgelegenheit misslingt, dann ist der Standardfall, dass wir einfach keinen Nutzen aus ihr ziehen. Manchmal liegt U_scheitert auch zwischen 0 und U_gelingt, z.B. dann, wenn die Ruine des Scheiterns nützliche Infrastrukturen hinterlässt.

Aber dann gibt es noch eine ganze Reihe von Fällen, wo U_scheitert einen negativen Wert hat. Etwa beim Autofahren. Eine Autofahrt ist nützlich, ohne Frage, aber eine gescheiterte Autofahrt kann schnell teuer werden?

Und diesen Kosten sind kaum Grenzen gesetzt? Vereinfachen wir und sagen, die maximalen Kosten des Scheiterns einer Pfadgelegenheit ist der eigene Tod. U_scheitert wäre dann – ∞ (minus Unendlich).

Die Möglichkeit des eigenen Todes ist im Stassenverkehr nur allzu real und da fragt sich, wie man dann überhaupt noch daran teilnehmen kann?

Zum Beispiel, indem man p einfach aufrundet?

Und ich fürchte, das aufgerundete p ist das Alltags-Yolo, das jeden von uns am Laufen hält!

Wir lügen uns in die Tasche, dass wir „das Risiko abschätzen können“ und tun einfach so, als wüssten wir nicht, dass wir das gar nicht wissen können.

Es hilft dabei, U_scheitert gar nicht so genau in Betracht zu ziehen und hier liegt das eigentliche Problem: U_scheitert wird erst mit Schmerz konkret. Krikorian wird den Fehler (hoffentlich) nicht noch einmal machen, denn U_scheitert ist bei ihm von einer abstrakten Möglichkeit zu einer Erfahrung geworden.

Paul Virilio sagte mal, dass jede Technologie ihre eigene Art von Unfall produziert. Aber das kann dauern? Der Three Mile Island Vorfall ereignete sich erst 24 Jahre nach der Einführung der zivilen Atomkraft, wir stecken erst gerade mitten im Unfall von Social Media und die Wucht des Unfalls der Dampfmaschine rollt gerade erst so richtig auf uns zu. Es gibt immer eine Ungleichzeitigkeit zwischen Technologie und ihrer durch Schmerzerfahrung informierten U_scheitert-Funktion.

Und trotz des Füllhorns von Katastrophen, die die LLM jetzt schon auf die Gesellschaft loslässt, bin ich überzeugt, dass wir den eigentlichen Unfall des Transformermodells noch gar nicht gesehen haben.

Techpolicypress enthüllt die Lobbyerfolge der Techfirmen, die Umweltschäden ihrer Datencenter gegenüber EU-Regulierung unsichtbar zu machen.

The European Commission incorporated a secrecy provision drafted by Microsoft and tech lobby group DigitalEurope into European Union law, blocking public access to critical information on data centers‘ environmental impact, an investigation led by Investigate Europe, an independent journalism cooperative, in collaboration with Tech Policy Press, has found.

The confidentiality clause — inserted into a 2024 implementing regulation under the EU Energy Efficiency Directive (Directive 2023/1791) — shields information on energy use and water consumption from affected communities, researchers and journalists. Ten legal scholars told Investigate Europe it may violate the EU’s obligations under the Aarhus Convention, an international treaty guaranteeing public access to environmental information.

With the EU set to triple its data center capacity over the next five years, the European Commission collects key metrics like energy efficiency and water consumption from facilities. But information on individual facilities‘ footprint is kept secret, after the industry pushed to amend the legislation to classify it as confidential and commercially sensitive.

Jerzy Jendrośka, a professor of environmental law at Opole University, who spent 19 years on the compliance body overseeing the Aarhus Convention, said: „In two decades, I cannot recall a comparable case. „This clearly seems not to be in line with the convention.“

Das Resultat ist eine strategisch stillgestellte U_scheitert-Funktion, mit der man den p-Wert der KI-Wette einfacher aufrunden kann.

As a result, only broad, national-level data is made public, while information about the precise impact of individual data centers is kept out of reach of affected communities, academics, journalists and the wider public.

Vielen dank, dass Du Krasse Links liest. Da steckt eine Menge Arbeit drin und bislang ist das alles noch nicht nachhaltig finanziert. Im März haben sich meine Einnahmen wieder erholt (573,71,-) aber sind noch weit weg von meinem Ziel, also von den notwendigen 1.500,-. Mit einem monatlichen Dauerauftrag kannst Du helfen, die Zukunft des Newsletters zu sichern. Genaueres hier.

Michael Seemann

IBAN: DE58251900010171043500

BIC: VOHADE2H

Dieser Newsletter ist nicht auf Reichweite ausgelegt, aber will dennoch Menschen erreichen. Du kannst dem Newsletter helfen, indem du ihn Freund*innen empfiehlst und ihn auf Social Media verbreitest.

Der Ökonom Alex Imas hat sich lesenswerte Gedanken über den Arbeitsmarkt unter AGI-Bedingungen gemacht. Die Gedanken sind auch abseits einer vollen AGI-Erwartung wertvoll, denn eine gewisse strukturelle Transiton im Arbeitsmarkt lösen die LLMs bereits aus.

Er prophezeiht, dass

- alle Tätigkeiten automatisiert werden, die sich automatisieren lassen und dass

- die automatisierten Bereiche, Produkte, Services in den Budgets der Menschen marginalisiert werden,

- so dass sich die Budgets auf die wenigen nichtautomatisierbaren Bereiche verschieben, also dort, wo die Mensch-Präsenz unerlässlich ist.

Das lehren jedenfalls die Beispiele aus anderen Strukturwandel-Ereignissen.

Economics has a name for what happens when a new technology makes one sector dramatically more productive: structural change. The canonical example is agriculture. In 1900, about 40% of the American workforce was employed in farming. Today it’s less than 2%. Did people stop eating? No, if anything they’re eating much more. Large scale automation made farmers—and eventually factory farms—much more productive. Agricultural production boomed and prices fell. But because people can only eat so much, the share of income spent on food went down as people got richer, and workers moved to manufacturing and then to services. The simultaneous fall of prices and reallocation of labor to another sector led to the perhaps non-obvious result that the more productive, automated sector became a smaller share of the economy despite serving and producing more. The less productive sector (services) where costs had not fallen—and in fact have risen—became a larger part of the economy. This is known as Baumol’s cost disease

Er folgert daraus – wie viele andere – eine „Abundance“ von automatisierbaren Produkten eintreten wird und ich finde das grundsätzlich etwas wackelig, denn menschliche Arbeitskraft ist nicht der einzige limitierende Faktor für so eine Zukunft. Die allgemeine Verfügbarkeit von einer Vielzahl von Rohstoffen, Materialien, Vorprodukten und komplexen globalen Lieferketten wird einfach angenommen, dabei sind das historisch gewachsene Strukturen, deren Zukunftserwartung – zumindest aus meiner Perspektive – so wacklig ist wie nie.

Aber gehen wir die Abundance-These mal probehalber mit und schauen, worauf er hinaus will.

Um seinen Punkt zu machen, konstruiert er sich ein interessantes, soziales „Wert“-Modell, für das er die Theorie des mimetischen Begehrens von René Girard beleiht.

Here I think it’s useful to have a closer look at the determinants of human preferences and desire. Economists typically model demand as if preferences are formed in isolation; the “utility” I get from a good, service, or experience is determined by its hedonics (e.g., how good did the coffee taste, how quickly did I get the coffee after ordering it).2 This makes sense when people’s budget constraints bind when it comes to meeting basic needs, e.g., for food, shelter, and clothing. But once those needs are met, a different force starts to shape what people want, and even becomes dominant. René Girard called it mimetic desire: the idea that we don’t desire objects only for their intrinsic properties, but because other people desire them as well. We want what others want, and we want it even more when they can’t have it—for status, social capital, reputation, etc. Desire is not just a relationship between a person and an object; it is also a function of what other people desires.

Kristof Madarasz and I provided support for the mimetic dimension of preferences in the context of basic economic exchange. We first developed a formal model where a person’s desire for a good increases in how much others want it but can’t have it. This predicts that people will value things more when there’s genuine exclusion, when access for a specific object is scarce and others are left wanting. In our experiments, willingness to pay roughly doubled when subjects learned that a random subset of people would be excluded from the product (Figure 2 below), even though the product itself was identical. This wasn’t status signaling (subjects were anonymous) or a scarcity heuristic (exclusion was random). It was purely driven by a pure preference for having something others don’t.

Und tatsächlich lässt sich eine Verschiebung der Wertpräferenz hinsichtlich von KI Arbeitsoutput bereits messen.

We find that AI involvement undermines the perceived exclusivity of a good; objects with AI involvement are perceived as inherently reproducible and non-unique. People bid for physical art prints that varied in described AI involvement. Human-made artwork gained 44% in value from exclusivity (one copy vs. many), but AI-generated artwork gained less than half that, only 21%. The mere involvement of AI made the work feel inherently non-exclusive, as if it could always be reproduced, regardless of how many copies were said to exist.

Dazu kommt ein ebenfalls messbarer Effekt: Wenn dein Einkommen weniger von Überlebensnotwendigen Dingen aufgebraucht wird, verschiebt sich das Budget Richtung mimetisches Begehren.

As you get richer, a larger share goes toward goods where you’re not just buying the functional product; you’re buying the story, the scarcity, the feeling of having something that others want as well. This is what gives relational goods and services their high income elasticity: as incomes rise, the exclusivity premium becomes a larger share of total value, and that premium is something human-made goods can deliver.

Here’s the mechanism more precisely. When AI automates commodity production, prices in that sector fall. That raises real income. If the goods and services people want more of as they get richer lie disproportionately in the relational sector, demand shifts in that direction. Baumol’s cost disease then amplifies the result: if the relational sector remains harder to automate, it becomes relatively more expensive and absorbs a growing share of total expenditure.

„Slop“ ist gewissermaßen die absolute relationale Dematerialisierung: Produkte und Services, die ihre Abhängigkeiten von menschlicher Aufmerksamkeit komplett entkoppelt haben.

Daraus ergibt sich folgendes Bild für die Zukunft:

Material abundance from automated manufacturing means goods are cheap. Most people’s spending goes to human-led services: today’s luxuries become the baseline for future consumers. As commodity production gets automated, income and employment flow toward the sectors with high income elasticity: what I am calling the relational sector, including the arts but also care, education, hospitality, therapy, personal services, craftsmanship, and community, where the human element is part of the value.

Some already exist and are growing: nurses, therapists, teachers, boutique fitness instructors, personal chefs, bespoke tailors, craft brewers, live performers, spiritual guides, childcare workers, and many varieties of hospitality and care work. Others are emerging: experience designers, human-AI collaboration artists, provenance certifiers, community curators. Many haven’t been invented yet, just as six out of ten jobs people hold today didn’t exist in 1940.

In der idealen Konfiguration dieser Welt haben wir alle genug Geld, um genau einen anderen Menschen zu bezahlen, damit er uns wie ein Mensch behandelt. Aber so wird das ja nicht kommen?

Die mehr oder weniger kleine Gruppe von Menschen, die „noch gebraucht“ wird, wird ein sehr heterogenes Auskommen haben.

Es wird die Menschen, geben, deren Aufmerksamkeit sich nicht substituieren lässt und sie werden enorme Gewinne daraus ziehen. Und dann wird es eine viel, viel größere Gruppe geben, deren Aufmerksamkeit so austauschbar ist, dass auch ihre Margen knapp über den Reproduktionskosten liegen, etwa, wie wir es bei einem Großteil der Menschen, sehen, die heute bereits als Pfleger*innen, Künstler*innen und in anderen „menschenzentrierten“ Berufen arbeiten.

Und weil menschlicher Input jetzt schon oft in weitgehend automatisierten und relational dematerialisierten Infrastrukturen extrahiert wird (man denke an Mechanical Turk von Amazon, oder dem Heer an Clickworker*innen auf den Philippinen oder in Kenia), kann man davon ausgehen, dass eine Menge Produkte und Services nur auf dem Papier automatisiert sind, aber auf dem Fulcrum bereitgestellter Mikro-Aufmerksamkeits-Ströme eines austauschbaren Arbeitsheers hebelt. (Eine Zukunftsvision, die komplementär ist zu den vielen Lagern, die derzeit überall aus dem Boden sprießen …).

Und was passiert mit dem Heer der Menschen, deren Aufmerksamkeit gar keinen ökonomischen Wert mehr hat, außer den ihrer Daten, die von den KI-Systemen aufgesogen werden, um sie ihnen als billigen Slop zurückzuspiegeln? Wird man es dabei belassen, sie in der semantischen KI-Umschließung ihrem vollautomatisierten Schicksal zu überlassen?

Vielleicht schon. Jedenfalls so lange, wie ihre Körper keinem Datencenter im Weg stehen.

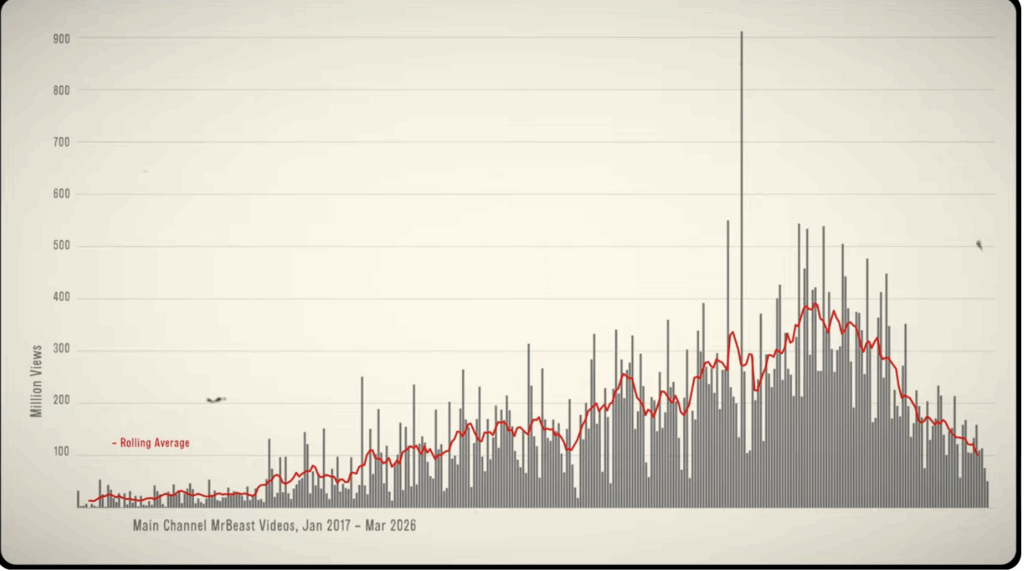

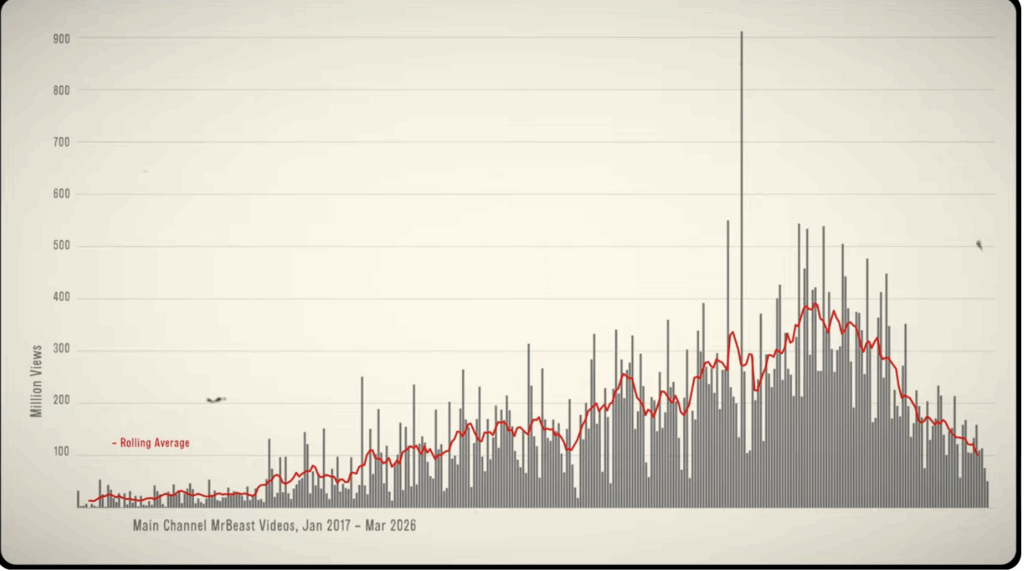

Dan Olson hat einen Video Essay darüber gemacht, warum er zu Mr. Beast ins Studio eingeladen wurde. Spoiler: Man erfährt es nicht, aber dafür eine Menge über den seelenlosen, Datengetriebenen und oft himmelschreiend ineffizienten Unsinn, den diese Leute da inszenieren. Unter anderem wird klar, dass die Methode Beast bereits aufhört, zu funktionieren.

Was Olson sehr gut herausarbeitet, ist, wie die Daten-Obession beim Beast Team dazu geführt hat, dass sie einfach immer schlechteren Content produzieren. Die ständige Jagd nach Rekorden und Viewcounts zerstört Storylines, schafft enorme Ineffizienzen und engt die Kreativität ein. Wenn eine Sendung komplett im Autopilot des Feedback-Loops zwischen Youtube-Algorithmus und Daten-Dashboards produziert wird, dann nimmt man sich wie Krikorian im Tesla die Möglichkeit, rechtzeitig ins Lenkrad einzugreifen.

Kyla Scanlon fragt sich in der New York Times ob die Finanzmärkte den Verstand verloren haben..

The stock market has been trying to ignore the war in Iran. That’s been true over weeks of escalation and de-escalation, cease-fires, a blockade, and a blockade of a blockade (now just a U.S. blockade). Markets have barely flinched, even as crude oil prices swing wildly each day and the world’s supply chains begin to shake.

The word to describe what is happening is “shrug.” The problem is not a lack of information. There is too much information, arriving in late-night social media posts and endless push notifications. These days when I see “Breaking News,” it feels like there’s an emphasis on “breaking,” in the sense of “Things are broken.”

Das, was zerbrochen ist, ist das Bewusstsein, dass die Wette schief gehen kann. Denn Papa Staat steht am Ende doch da und fängt alle größeren Akteure auf (too big to fail), nicht?

More broadly, the markets are showing the single lesson that the past 40 years have taught them.

It will always be saved.

Markets are not properly pricing risk, because they really don’t have to. They have assumed that the U.S. government will not allow them to implode, and that assumption is putting the world economy at stake. What’s more, the new rescuer investors are counting on — artificial intelligence — is vulnerable to the exact risks markets are ignoring.

When Paul Volcker took the reins of the Federal Reserve in 1979, he showed that the central bank was willing to use rates as a blunt instrument. He hiked the federal funds rate above 20 percent to crush inflation, deliberately inducing a recession. It was brutal and effective, with unemployment rising and inflation cratering. His efforts saved the economy by destroying it, while establishing the precedent that the Fed could and would move the economy.

Alan Greenspan imparted the same lesson, but in an inverted way. Where Mr. Volcker disciplined markets, Mr. Greenspan rescued them. When the stock market crashed in October 1987, on a day known as Black Monday, Mr. Greenspan flooded the system with liquidity and cut rates.

Die Bailout-Erwartung ist inzwischen das zentrale stabilisierende Fulcrum aller Finanzwetten der großen Akteure und diese Bailout-Erwartung kann dafür eine beachtlich lange Historie beleihen.

That implication has a nickname — the “Greenspan put.” The implicit understanding (never written or formalized) is that the Fed would ease monetary policy whenever asset prices fell hard enough. It was necessary in many situations, but it also created a reflex.

For example, in 2008, Ben Bernanke, then the Fed chair, took rates close to zero and carried out three rounds of quantitative easing in response to the financial crisis. The Fed deployed trillions of dollars in asset purchases at a staggering scale and became a direct buyer in markets.

U_scheitert ist nach all den Jahren des Greenspan-Puts nur noch ein verbleichendes Schwarzweißfoto im Familienalbum des letzten Jahrhunderts und die Bailout-Erwartung ist bereits so ausgeprägt, dass sie selbst bei kleineren Hickups eingefordert wird.

The markets came to expect a form of salvation. In fact, markets expected so much support that they threw what were called “tantrums” when they didn’t get it — as in 2013’s “taper tantrum,” when Mr. Bernanke suggested (suggested) that the Fed would be buying up fewer bonds. The bond market freaked out, with the 10-year yield jumping from 2 percent to 3 percent in a few months, setting off a cascade of depreciation in emerging-market currencies. The markets learned: They could demand rescue.

Then Covid happened. Both Congress and the Fed deployed trillions in combined and coordinated fiscal and monetary support within weeks at breakneck speed and scale. The stock market hit all-time highs within months of the worst economic shock since the Great Depression.

Doch, ob das stablisierende Fulcrum des Greenspan-Puts im Falle eines Crashs „hält“, ist heute mehr als fraglich?

The problem is that the rescue infrastructure is exhausted. The Fed is trapped. Inflationary pressures mean that rate cuts, the most powerful tool in the monetary tool kit, could risk making things worse. The Greenspan “put” is not really in the cards.

Fiscal policy is equally constrained. U.S. debt levels have reached a point at which any new spending programs face real limits. The dollar’s role as the global reserve currency is showing cracks. Foreign holders of Treasuries are watching U.S. policy with increasing skepticism.

Während also auch hier „p“ durch Narkotisierung von U_scheitert aufgerundet wird, basiert die gesamte Zukunftserwartung von U_gelingt auf der Ankunft von AGI.

The only real backstop, if you look at where the money is going, is artificial intelligence.

This reliance on A.I. looks like an extraordinary concentration of bets. The Magnificent 7 (Google’s parent, Alphabet; Amazon; Apple; Facebook’s parent, Meta; Microsoft; Nvidia; and Tesla) are over 30 percent of the S&P 500, up from about 12 percent a decade ago. The four largest hyperscalers — Alphabet, Microsoft, Meta, Amazon — are projected to spend nearly $700 billion combined in 2026 on A.I. infrastructure, an increase of more than 60 percent from last year, and are spending so aggressively that they’re likely straining their cash cushions.

The implicit argument embedded in current valuations across both public and private markets is that A.I. will be productive enough to offset an economic downturn as the economy loses jobs from A.I. The valuations also suggest that the A.I. industry will be efficient enough to navigate an energy crisis with the knowledge to reroute supply chains disrupted by, say, war. […]

This redirects moral hazard from “the Fed will bail out the banks” to “the government will bail out A.I.” Call it the A.I. put — and this isn’t a critique of A.I. companies. They are responding to the incentives of a favorable policy environment.

Aber was würde das überhaupt bedeuten, dass die KI-Wette aufgeht? Wie sieht eine U_gelingt-Welt aus, in der sich die exorbitanten Summen gerechnet haben, die bereits in KI investiert wurden?

Ricardo Hausmann and Andrés Velasco untersuchen im Project Syndicate, welche ökonomischen Realitäten hergestellt sein müssten, um die bereits jetzt investierten Milliarden profitabel zu machen.

Is the AI boom a bubble? No one can be sure. But one way to answer that question is to ask a more manageable (and more interesting) one: What kind of world economy would have to emerge for today’s market valuations to make sense? Consider the core group of firms at the center of the AI story: Nvidia, Alphabet, Apple, Microsoft, Meta, Broadcom, Tesla, OpenAI, Anthropic, SpaceX-xAI, and Amazon Web Services. Taken together, they embody a remarkable market wager. Under a conservative benchmark—that by 2036 these firms trade at price-earnings ratios of 20, earn net profit margins of 20%, and obtain 65% of their incremental revenue from abroad — in a decade they would generate roughly $2.4 trillion in additional annual foreign revenue. Such revenue is roughly equal to all US goods exports today and over twice the US current-account deficit.

Granted, the United States will have to import some inputs (like semiconductors) to provide those AI services. And not all rents will accrue to Americans, because foreigners also hold shares in US tech companies. But the offset is likely to be small: foreigners reportedly own just 15–20% of the S&P 500 stock index. These striking figures should prompt us to rethink much of today’s global macroeconomic debate.

For years, discussion of global imbalances has revolved around a familiar concern: how long can the US continue to run large external deficits? But if markets are even approximately right about AI, the more urgent question is how the rest of the world will pay for the growing claims of US-owned AI capital on global income. This is a striking reversal. The world will not merely be asked to recognize America’s technological lead. It will be asked to pay for it—year after year, and on a vast scale. Forget the broad-based industrial export surge President Donald Trump keeps promising; the world’s payments will be to a relatively small group of firms that control the large language models, chips, cloud infrastructure, software ecosystems, and complementary platforms on which the AI age depends. How exactly is the rest of the world supposed to pay?

Damit KI in der aktuellen Investitionsstruktur profitabel ist, müsste die Welt den USA jedes Jahr den Gegenwert des Bruttoinandsprodukts eines mittleren G7-Staats überweisen. Die Summe entspricht auch grob 14 mal den Marshallplan, der Europa nach dem zweiten Weltkrieg wieder aufbaute. Aber pro Jahr einem, statt über vier Jahre.

Aber was, wenn Imas recht hat und dicke Margen gar nicht im Möglichkeitsbereich der Branche liegen?

Bereits 2023 machte ein geleaktes Memo eines Googlemitarbeiters furore, in dem er darauf aufmerksam macht, dass Google keinen „Moat“ hat, keinen Burggraben, um ihre Margen zu beschützen. Die Industrie hat Skaleneffekte, Plattformen haben Netzwerkeffekte, Leitunternehmen geringe Austauschbarkeit, aber was hat KI?

Das Memo war auf die damals schon aufschließenden Open Weights-Modelle bezogen, aber die Tatsache, dass Anthropic so leicht an OpenAI in Sachen Revenue vorbeiziehen konnte, deutet darauf hin, dass es diesen Moat grundsätzlich nicht gibt. Die Modelle sind unterschiedlich stark, aber am Ende doch sehr austauschbar. Vieles deutet darauf hin, als würde KI ein „low margin“ Business, wie Internetprovider, selbst, wenn es einen Großteil der globalen Workforce frühstückt.

Deswegen ist der KI-Coup nicht optional.

Um die Welt in Datencenter zu verwandeln und die Marge aus allen Ritzen zu pressen, reicht es nicht, populäre Bedürfnisse zu erfüllen. Stattdessen muss die KI helfen, Macht abzusichern, also Gewalt zu organisieren und nur dafür wird man versuchen, die Branche im Crash mit Steuergeld zu retten.