Willkommen bei Krasse Links No 16. Schnallt eure Fallschirme an, wir folgen heute einer hierarchischen Stufenleiter in die Objektivität und springen von dort in die Semantiken.

Die Vorstellung von GPT-4o ist ein weiteres Indiz dafür, dass die Entwicklung von LLMs plateaut. Statt eines besseren Modells wurde ein günstigeres vorgestellt, statt eines Modells, das mehr kann, wird es mit einem neuen Sprachinterface ausgestattet. Und auch die Art der Interaktion des Sprachinterfaces deutet auf andere Anwendungsfälle hin, die OpenAI jetzt anscheinend anstrebt: 4o kichert, macht bedeutungsvolle Pausen, trällert charmant, flirty und ein bisschen geschwätzig, so dass sich einem die Parallelen zu dem Film „Her“ geradezu aufdrängen.

OpenAI scheint die zukünftigen Usecases also weniger in produktiven Jobs zu sehen (dafür sind die Dinger nach wie vor – und ich schätze, auf absehbare Zeit – zu unzuverlässig), sondern im Beziehungsersatz? Brian Merchant nimmt das zum Anlass, Silicon Valleys weirde Beziehung zu Science Fiction aufzudröseln und bringt dabei auch die sich abzeichnende Produktidee auf den Punkt:

„With Her, it’s even simpler — lots of people, especially lonely men, would like to be surrounded full-time by a Scarlett Johansson bot that acts like it cares deeply about them and thinks they’re funny. Who cares if ultimately it is revealed in the film that the AI was not actually engaging in a personal loving relationship with the protagonist but a simulation of one, and that simulation was keeping him — and humans everywhere — from enjoying basic human experiences and depriving them of lasting connection with other people? It’s a personal 24/7 Scarlett Johansson AI companion.“

Nachdem die Techgiganten unsere Beziehungen verschlangen und sie zu ihrem „For You“-Algorithmus verdauten, bieten sie uns jetzt digitale Ersatzbeziehungen an. Die beschweren sich auch nicht, wenn man sich mal Wochenlang nicht meldet, sind nachsichtig mit unseren Ticks und geben uns immer recht.

Und wenn man einmal durchdenkt, welche Macht abusive Relationship-Dynamiken und emotionale Abhängigkeit haben, schreibt sich das Geschäftsmodell von selbst? Ich fürchte, es entsteht gerade die perverseste, kapitalistische Incentive-Struktur seit Fentanyl?

Im Hard Fork Podcast interviewten Casey Newton und Kevin Rose den CEO von Nomi, einem Anbieter für Beziehungs-KIs, Alex Cardinell. An einer Stelle fragen sie ihn, wie sie zum Beispiel mit Chats über Selbstmordgedanken umgehen:

Casey Newton

I’m curious about some of those things. If you have a user that’s telling a Nomi, I’m having thoughts of self-harm, what do you guys do in that case?Alex Cardinell

So in that case, once again, I think that a lot of that is we trust the Nomi to make whatever it thinks the right read is often times because Nomis have a very, very good memory. They’ll even remember past discussions where a user might be talking about things where they might know is this due to work stress, are they having mental health issues? What users don’t want in that case is they don’t want to hand-scripted response. That’s not what the user needs to hear at that point. They need to feel like it’s their Nomi — communicating as their Nomi for what they think will best help the user.

Hach, Technologie. Sie eröffnet immer neue Wege, Verantwortungsübernahme zu verweigern.

Die Koryphäe der Klimawissenschaft, Joachim Schellnhuber, hat dem Stern ein Interview gegeben:

Hätten Sie 1990 erwartet, dass es so kommt?

Nein. Grundlegendes Wissen zum Treibhauseffekt gab es schon lange. Die entscheidende Berechnung wurde bereits 1896 durchgeführt. Aber über die Folgen der Erderwärmung wurde Anfang der 1990er Jahre allenfalls spekuliert und an einen Temperaturanstieg von über zwei Grad hat niemand wirklich geglaubt. Als ich 1992 das Potsdam-Institut für Klimafolgenforschung gründete, rechnete ich fest damit, dass es nach 25 bis 30 Jahren wieder eingestampft würde, weil dann das Klimaproblem gelöst wäre.

Waren Sie naiv?

Das war plausibler Zweckoptimismus. Wir dachten, es geht immerhin um das Überleben unserer Zivilisation, die Menschheit kann gar nicht so verbohrt und gleichgültig sein, dass sie hier nicht entschlossen gegensteuert. Dass man zum kollektiven Selbstmord aus Bequemlichkeit bereit ist, ging über unsere Vorstellungskraft.

Ich muss ehrlich gestehen, dass es mir immer schwerer fällt irgendwelche Dinge über die Klimakatastrophe oder auch nur Klimapolitik zu lesen, es ist einfach zu deprimierend. Ich kann total verstehen, dass man das verdrängen will und ich glaube, das ist, was passiert. Und zwar überall, nicht nur bei AfD, FDP und CDU, sondern auch bei den Grünen und ihren Anhänger*innen und sogar bei Schellnhuber und seinen Kolleg*innen die trotz allem an der Illusion festhalten, den fossilkapitalistischen Komplex wegschmusen zu können.

In diesem spannenden Aufsatz widmen sich die Jurist*innen Matthew Sag und Tonja Jacobi der Frage, was die Biases in generativer KI über uns als Gesellschaft aussagen. Sie nehmen dafür die Empörung um die zu „woken“ Bilder von Googles Bildgenerierungs-KI als Ausgangspunkt und performen damit den einen Anwendnungsfall der Technologie, für den ich generative KI nicht mehr missen möchte: KI als Spiegelbild der Gesellschaft, bzw. als Spiegelbild der gesellschaftlichen Semantiken.

Sie arbeiten vier Probleme heraus:

- Die Trainingsdaten bestehen zum großen Teil aus Dokumenten westlicher, weißer, männlicher Perspektiven.

- Dazu kommen die bis heute bestehenden Ungleichheiten und Biases, die sich über alle möglichen Wege in die KIs abfärben.

- Das dritte Problem besteht darin, dass wir das Ideal einer inklusiveren und gleicheren Gesellschaft pflegen, als wir in der Realität sind und Technologie kann nicht unterscheiden, ob wir gerade ein realistisches, oder ein ehrgeizigeres Bild der Gesellschaft verlangen.

- Zuletzt sehen die Autor*innen eine generelle Überschätzung der Fähigkeiten von aktuellen KI-Ansätzen. Deren Output kann zwar im ersten Eindruck verblüffen, doch ist er schon per technischer Definition im wahrsten Sinne des Wortes konventionell.

Midjourney can produce an image of a cat on Pluto, Sonu.ai can write a song about a cat on Pluto, and even though these combinations are new, there is something highly conventional about the resulting digital artifacts. Because the output of Generative AI inherently gravitates toward the center of a distribution implied by the training data, it confronts us with a reflection of the mean of that data.

In diesem Newsletter sehen wir in generativer KI Semantik-Navigiermaschinen, deren ganze Fähigkeit sich darin erschöpft, plausible Token-Pfade von einem Ort im tausenddimensionalen Latent-Space zu einem anderen Ort in diesem Latentspace zu finden. Der Latent-Space ist dabei nur eine Art Abdruck – eine aus Milliarden von menschlichen Aussagen statistisch syndizierte Landkarte – unserer gesellschaftlichen Semantiken.

Und das macht jede Bedienung einer generativen KI zu einer Eiskernbohrung in das semantische Unterbewusstsein der Gesellschaft, das dann so alltagskulturelle Artefakte wie den „Male Gaze“ zutage fördert:

„Because the training data for Midjourney, DALL-E-3, and the like is made up mostly made of images of women produced by western men, the outputs of those models reflect typically western male aspirations of women’s appearances, deferential attitudes, and roles. They reflect the male gaze.“

Ja, auch Blicke sind Semantiken, die im Latent-Spaces kodiert sind und der Male Gaze ist nicht der einzige Blick. Zumindest dürften die heutigen KIs genug Bilder/Texte gesehen haben, um eine Vielfalt der Blicke zu kodieren, doch meine Vermutung ist, dass das dann im Fine-Tuning gestreamlined wird?

In den ersten Versionen von ChatGPT konnte man die Antwortqualität deutlich verbessern, wenn man dem Modell eine Identität zuwies: „Du bist ein Arzt“ oder „Du bist eine Professorin für Linguistik“, etc. Mit Donna Haraways bereits besprochener These der Situiertheit des Wissens ergibt dieser Hack absolut Sinn, denn es hilft dem Modell ungemein, wenn man ihm einen expliziten Ort als Startpunkt für die zu navigierenden Semantikpfade zuweist.

Wenn man den Trick heute anwendet, nimmt ChatGPT leider nicht mehr die zugewiesene Identität an, sondern reflektiert als „hilfreicher Chatbot“ über die vorgeschlagene Perspektive. Ich schätze, sie haben ihren GPTs die Multiperpektivität abtrainiert, um „objektivere“ und besser reproduzierbare Antworten zu generieren. Aber an den Open-Source-Dingern könnte sich tatsächlich sowas wie eine kulturwissenschaftliche Semantologie entwickeln?

Udi Greenberg liefert eine lesenswerte Besprechung des neuen Buches von Stefanos Geroulanos: The Invention of Prehistory: Empire, Violence, and Our Obsession with Human Origins. Greenberg stellt das Buch in den Kontext von Hararis Homo Deus und Wengrow/Graebers: The Dawn of Everything, die beide den Versuch darstellen, das Heute aus der Vorhistorie zu erklären.

Geroulanos, bzw. Greenberg zieht die ganze Debatte auf die Metaebene und zeigt, dass die Rede von der Vorzeit schon immer im Zeichen der politischen Instrumentalisierung stand, deren Beginn nicht zufällig in die Kolonialzeit fällt. Die Vorgeschichte gab uns Europäern ein Framework, um die Völker auf die wir bei unseren „Entdeckungsreisen“ stießen, hierarchisch unter uns einzuordnen.

As part of their justification for new conquests, many white Europeans and their counterparts in North America insisted that Asians, Africans, and Indigenous Americans lived in an earlier mode of existence. They may have breathed the same air and drunk the same water, but they represented an earlier and “primitive” stage of development, which allegedly lacked culture and self-control. The Enlightenment’s love of tripartite schemas proved especially convenient for this purpose, as many thinkers utilized them to divide humanity into three distinct stages.

Und hier sind wir im Glutkern dessen, was ich neulich als Ideologie der „White Supremacy“ bezeichnete: Die Idee einer lineralen Hierarchie der gesellschaftlichen Entwicklung als dessen vorläufigen Endpunkt wir uns selbst begreifen und in die wir alle anderen Kulturen als unterentwickelte Vorformen unserer Selbst einordnen:

Even worse, sweeping narratives that go from the stone age to our times perpetuate the colonialist belief that all human history culminates with us. As Geroulanos puts it, our culture fetishizes stories of origins because they allow us to “admire our grandeur.” This equation of ourselves with “humanity” in fact ironically leads us to depict those who do not fit our narratives as not fully human. “Humanity still bleeds,” he despairs, because we still so often think of our enemies as imprisoned in “a supposedly savage past” from which only war could provide rescue.

Ich seh das so: ganz offensichtlich gibt es irgendwo einen Entwicklungspfad von der Steinzeit zu unserer heutigen, westlichen Zivilisation, aber das macht ihn halt nicht zu einem besseren Pfad als andere Pfade? Während wir in unseren endlosen Kriegen unsere ganze Energie darauf verschwendeten, effizientere Wege zu finden, uns gegenseitig die Köpfe einzuhauen, arbeiteten andere Kulturen halt lieber an ihrem Bewässerungssystem, erfanden medizinische Operationen, entwickelten unfassbar komplexe Wissensstrukturen, zu Astronomie und Mathematik und ausgefeilte politische Bündnisstrukturen mit demokratischen und konsensualen Elementen. Und ja, unser spezieller Entwicklungspfad erlaubte uns, diese Kulturen auszulöschen, beziehungsweise sie gewaltsam zu unterwerfen und auszubeuten, aber wenn das etwas über unsere Kultur aussagt, dann höchstens, dass wir Arschgeigen-Weltmeister sind und wenn ihr im globalen Süden mal rumfragt, dann ist das ziemlich genau das, was man als Westler so gespiegelt bekommt?

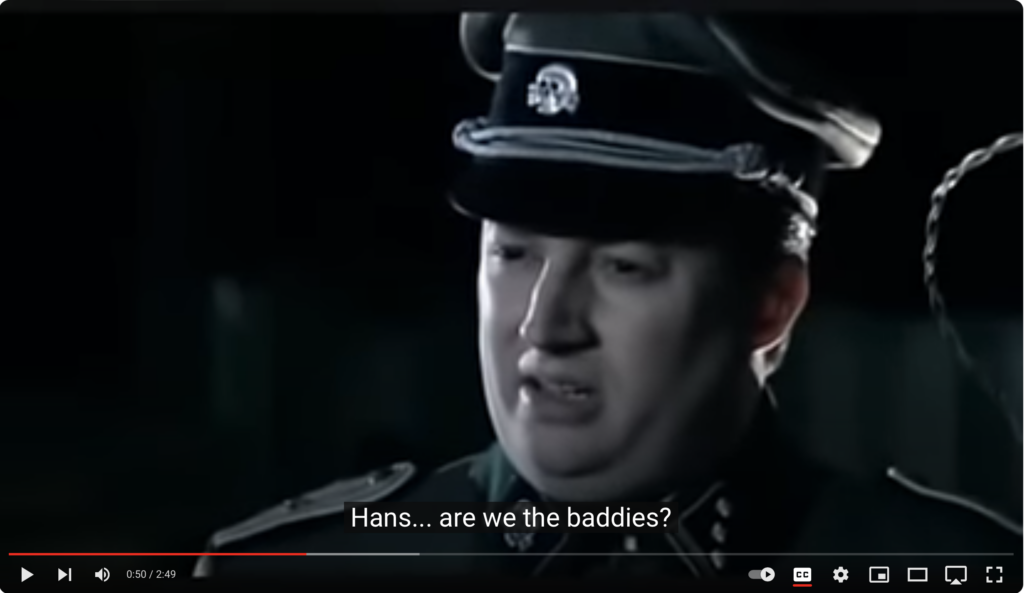

Ich sehe schon, warum so ein Selbst- und Weltentwurf in Zeiten des Kolonialismus nützlich war, doch diese extrem tiefsitzende Pfadentscheidung bestimmt bis heute unseren Blickwinkel auf die Welt (ja, auch meinen immer noch, obwohl ich mir immer mehr darüber bewusst werde) und manifestiert sich in so unterschiedlichen materiell-semantischen Komplexen wie die Suche nach AGI, dem Bau der Festung Europa, der Idee des American Exceptionalism, dem politischem Zionismus, Star Trek und sogar in Russki Mir. Und ich finde, angesichts dieser Kontinuität kann man sich schon mal fragen: are we the Baddies?

Frédéric Valin macht im ND eine wichtige Unterscheidung:

Die Arbeiter*innenliteratur hatte in Deutschland schon immer einen schweren Stand, inzwischen ist sie nahezu inexistent. Substituiert wird sie spätestens seit Didier Eribons »Rückkehr nach Reims« von einem Genre, das man Arbeiter*innenkinderliteratur nennen könnte. Bevorzugtes Mittel dieses Genres ist die Autobiografie, die angelegt ist wie ein Künstlerroman des 19. Jahrhunderts: Den Werdegang der Protagonist*innen erzählen und von all den kleinen und großen Kränkungen und Unsicherheiten, Fehltritten und Erweckungen, wie sie auch ein Frédéric Moreau in Flauberts »Éducation sentimentale« durchläuft. Unterbrochen wird der Erzählfluss nach dem Vorbild Eribons durch soziologische Einsprengsel und psychologische Überlegungen.

Diese Geschichten von der Emanzipation der eigenen Vergangenheit, der Emanzipation von den Eltern, sind liberale Individualisierungsgeschichten. Oder wie es Iuditha Balint, Leiterin des Fritz-Hüser-Insituts, ausdrückt: Die Protagonist*innen der Arbeiter*innenliteratur stehen für ein »Wir« ein, für ihre Klasse. In der Arbeiter*innenkinderliteratur aber tritt das »Ich« viel stärker hervor.

Auch der Klassismus basiert auf der Vorstellung einer linearen Stufenhierarchie, als dessen Endpunkt sich die (bildungs-)bürgerliche Klasse versteht, die man durch „sozialen Aufstieg“ erreichen kann.

Die New York Times hat einen extrem durchrecherchierten Longread über die Siedlergewalt im Westjordanland veröffentlicht und wie sie über die Zeit die israelische Politik eingenommen hat. Der Report ist so lang wie erschreckend und im Zentrum steht dabei die schulterzuckende Nicht-Durchsetzung des Rechts gegenüber der Siedlergewalt an den Palästinensern, doch diese Gewalt ist Ausgangspunkt für politische Dynamiken, die den Staat Israel in seiner Existenz gefährden.

The long arc of harassment, assault and murder of Palestinians by Jewish settlers is twinned with a shadow history, one of silence, avoidance and abetment by Israeli officials. For many of those officials, it is Palestinian terrorism that most threatens Israel.

[…]

A long history of crime without punishment, many of those officials now say, threatens not only Palestinians living in the occupied territories but also the State of Israel itself.

Eines der Beispiele, dem sich der Artikel im Detail widmet, ist die Geschichte des kleinen Dorfes Khirbet Zanuta, dessen Bewohner über Jahre von Siedlern terrorisiert wurden, bis sie fliehen mussten, sich aber jetzt mithilfe der Anwälte von Haqel, einer Israelischen Menschenrechtsorganisation, gerichtlich zur Wehr setzen.

They [die Anwälte] stated that the raid was part of “a mass transfer of ancient Palestinian communities,” one in which settlers working hand in hand with soldiers are taking advantage of the current war in Gaza to achieve the longer-standing goal of “cleansing” parts of the West Bank, aided by the “sweeping and unprecedented disregard” of the state and its “de facto consent to the massive acts of deportation.”

Nach dem Lesen des Artikels finde ich es zwar immer noch nicht „antisemitisch“ diese Zustände als „Apartheid“ zu bezeichnen, aber eben auch nicht korrekt? Der südafrikanische Appartheitsstaat hatte immerhin klare Regeln. Für das, was in der Westbank passiert gibt es wahrscheinlich noch gar keinen Begriff?

Ein anderer Strang des Artikels geht der rechtsterroristischen Bewegung nach, die sich aus dieser Situation entwickeln konnte und die nicht erst seit gestern den israelischen Staat bedroht. Das bekannteste Ereignis ist hier sicher das Attentat auf Jitzchak Rabin 1995 von dem sich eine personelle und ideologische Kontinuität bis direkt ins heutige Regierungskabinett ziehen lässt.

Eine Journalistin fährt auf eine Hundeshow und schmust ganz viele unterschiedliche Hunde. Das wars. Das war die Empfehlung.

OpenAI springen einige ihrer wichtigsten Wissenschaftler ab. Nachdem der Chef-Researcher Ilya Sutskever bereits verabschiedet hatte, geht jetzt auch Jan Leike, der für AI-Safety zuständig war und sagt:

“These problems are quite hard to get right, and I am concerned we aren’t on a trajectory to get there,” he wrote, adding that it was getting “harder and harder” for his team to do its research.

“Building smarter-than-human machines is an inherently dangerous endeavour. OpenAI is shouldering an enormous responsibility on behalf of all of humanity,” Leike wrote, adding that OpenAI “must become a safety-first AGI company”.

Der ganze KI-Komplex denkt Intelligenz in kolonialistischer Tradition als lineare Stufenleiter, mit uns noch auf der obersten Stufe, bis uns die Artificial Generell Intelligence (AGI) ein- und dann überholen wird. Und weil im Valley so viele super verantwortungsbewusste Sternenflottenoffziere arbeiten, feilen sie gleichzeitig an einer mega fortschrittlichen Super-Ethik, die man dem System einbimst, damit es uns nicht in Büroklammern verwandelt.

Das klingt alles furchtbar lächerlich, aber das ist gar nicht der Hauptgrund, warum ich keine Angst vor AGI habe. Ich glaube einfach, dass Intelligenz niemals „generell“ ist, sondern immer spezifisch. Das, was wir als Intelligenz bezeichnen ist ein sich weit verzweigendes Netz aus Semantiken, die in nichtlineraren, nichthierarschischen Zusammenhängen stehen und in dem wir jeweils nur eine kleine Nische bewohnen.

Ganz sicher wird es gelingen, KIs zu entwickeln, die in manchen oder gar vielen Kompetenzbereichen über menschliche Skills hinaus gehen (was schlimm genug ist, aber hier nicht das Thema), aber wenn Künstliche Intelligenz jemals echte Kreativität beeinhalten soll, also die Fähigkeit neue Dinge zu sehen, denken, hören, sagen und fühlen zu können, dann wird sie lernen müssen, das Netz der Semantiken zu erweitern. Und das geht nie alleine, sondern nur im wechselseitigem Austausch.

Caroline Haskins berichtet für den Guardian von der AI Expo for National Competitiveness, einer unter anderem von Eric Schmidt und Palantir ins Leben gerufenen Messe, auf der der militärisch-industrielle Komplex mit dem Silicon Valley kuschelt. Der ganze Artikel ist unwirklich und sehr lesenswert, aber ich will hier nur die Beschreibung des Palantirstandes zitieren, wo ein Projekt namens „Civilian Harm Mitigation“ vorgestellt wurde.

The woman described how Palantir’s Gaia map tool lets users “nominate targets of interest” for “the target nomination process”. She meant it helps people choose which places get bombed.

After she clicked a few options on an interactive map, a targeted landmass lit up with bright blue blobs. These blobs, she said, were civilian areas like hospitals and schools. The civilian locations could also be described in text, she said, but it can take a long time to read. So, Gaia uses a large language model (something like ChatGPT) to sift through this information and simplify it. Essentially, people choosing bomb targets get a dumbed-down version of information about where children sleep and families get medical treatment.

“Let’s say you’re operating in a place with a lot of civilian areas, like Gaza,” I asked the engineers afterward. “Does Palantir prevent you from ‘nominating a target’ in a civilian location?”

Short answer, no. “The end user makes the decision,” the woman said.

Wenn der der westliche „Gaze form Nowhere“ eine heilige Stätte hat, dann liegt sie nicht in Israel, sondern im Silicon Valley und Steward Brand ist ihr Prophet. Sein Whole Earth Catalog inspirierte Steve Jobs, er organisierte die erste Hackerkonferenz, gründete eine der ersten und die wahrscheinlich einflussreichste Online Community The Well, aus dessen kulturellem Kosmos die Wired und der EFF hervorgingen.

Brands Geschichte beginnt auf einem Dach, auf dem er seinen Mushroomtrip mit einem Joint ausklingen lies und darüber nachdachte, dass die Welt unbedingt eine Aufnahme von sich aus dem Weltall braucht. Der Erzählung nach macht er so lange Stress bei der Nasa, bis sie ein Foto von der Erde rausrücken und dieses Foto, die Blue Marble, verändert die Welt.

Aber die Blue Marble ist ein Vexierbild. Ja, man kann aus dieser Verortung im Universum eine gewisse Demut ziehen, wenn man will. Man kann die Marble aber auch mit einem slicken Interface versehen und schon hat man Google Maps?

Vom Whole Earth Catalog über Apple, Google und Palantir (was der „allsehende Stein“ in Herr der Ringe ist) bishin zu den Hunderten von Milliarden Dollar, die gerade in die Entwicklung von AGI fließen, arbeitet das Silicon Valley daran, den „Gaze from Nowhere“, als die letztgültige Objektivität zu materialisieren, mit der man die ganze Welt in ein riesiges Gaza verwandeln kann. Doch wenn man Haraway glaubt, dann haben sie ihre eigenen Systeme nicht verstanden:

„The „eyes“ made available in modern technological sciences shatter any idea of passive vision; these prosthetic devices show us that all eyes, including our own organic ones, are active perceptual systems, building on translations and specific ways of seeing, that is, ways of life. There is no unmediated photograph or passive camera obscura in scientific accounts of bodies and machines; there are only highly specific visual possibilities, each with a wonderfully detailed, active, partial way of organizing worlds.

Pingback: Krasse Links No 17. | H I E R

Pingback: Krasse Links No 18. | H I E R